👋 Pokrok v AI – newsletter č. 18

Přichází další vydání našeho newsletteru shrnující nejzajímavější novinky ze světa AI, tentokrát o AlphaFold 3, kličkách v Aktu o AI, budoucnosti humanoidních robotů i "dobrovolné seberegulaci".

Vítejte v osmnáctém vydání našeho newsletteru Pokrok v AI, ve kterém shrnujeme nejnovější poznatky a vývoj v oblasti používání umělé inteligence (AI), strojového učení (ML) a AI policy a regulace.

👀 Špehování i bez povolení?

Obavy týkající se vlivu umělé inteligence na demokracii se začaly vynořovat už před lety. Zpřístupnění ChatGPT pak vedlo především k úvahám o zneužití AI pro šíření dezinformací. Organizace Iuridicum Remedium (IuRe) ale nedávno upozornila na fakt, že se české Ministerstvo vnitra snaží zlegalizovat nepřetržité používání biometrických sledovacích systémů. Chce tak učinit ještě předtím, než vstoupí v platnost Akt o AI, který používání biometrických sledovacích systémů bezpečnostními složkami zásadně omezuje a vyžaduje pro ně předběžné povolení soudu nebo nezávislého správního orgánu. Dle vyjádření IuRe pro deník Echo24 se Ministerstvo vnitra snaží těmto kontrolním mechanismům vyhnout.

Proti tomu, aby bezpečnostní složky mohly používat biometrické sledovací systémy i s patřičnými povoleními, bojovaly při vyjednávání Aktu o AI různé nevládní organizace zaměřující se na lidská práva i některé politické skupiny v Evropském parlamentu s odkazem na zneužívání sledovacích biometrických systémů v Čínské lidové republice. Jak český příklad ukazuje, jejich obavy ze zneužití této škvíry pravděpodobně nebyly úplně neopodstatněné.

🤖 Humanoidní roboti na vzestupu

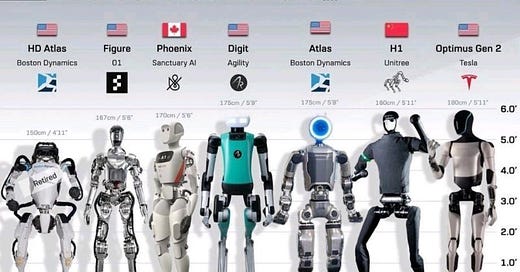

Humanoidní roboti jsou na vzestupu a za jejich úspěchem stojí z velké části velké jazykové modely (LLMs), které slouží jako jejich prefrontální kortex. Historicky jsme byli svědky čím dál tím lepšího a levnějšího robotického hardwaru. Boston Dynamics a jejich humanoidní robot Atlas, který umí třeba dělat parkour, metat salta nebo tancovat, vydláždili cestu, kterou dnes kráčí celá plejáda humanoidů. Jejich původně hydraulicko-elektrický systém byl nahrazen Atlasem novým, který je již čistě elektrický a podle svých tvůrců je navržen pro každodenní použití.

Zájem o lidem podobný humanoidní roboty je teď obrovský hlavně proto, že začínají fungovat! Naše proto-AGIs jsou již natolik silné, že dokáží robustně generalizovat z malého počtu demonstrací různých úkonů, které by mohl robot dělat. To umožňuje jejich široké využití.

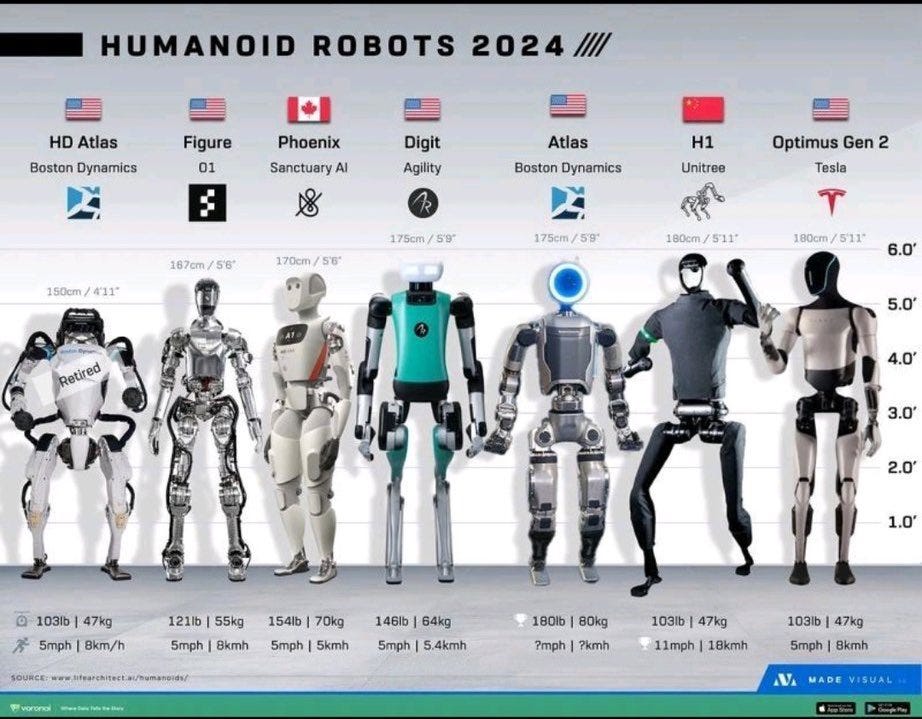

Jeden z protiargumentů bývá to, že není potřeba vytvářet humanoidní roboty, kteří jsou podobní lidem, protože můžeme raději vytvářet specializované průmyslové roboty (neživotný rod). Protiargumentem, se kterým souhlasíme, je ale toto: Většina levně a snadno automatizovatelných částí průmyslu už takto dávno zautomatizována byla (představme si třeba robotické ruce, které svařují části nového auta). Zbývají tedy důležité, ale méně repetitivní a standardizované úkony, pro které se ekonomicky nevyplatí vytvářet jednoúčelové roboty. Tedy tento argument dělá jeden z inženýrů pracující na robotovi Optimus od společnosti Tesla:

To, co nás kolem dnešní vlny humanoidních robotů naplňuje optimismem, je, že vzhledem k velkému počtu dobře financovaných společností, kteří se je pokouší vytvořit, 1) buď jedna z nich uspěje a my, zákazníci, si je budeme moci koupit, a nebo 2) se objeví nějaká velká inženýrská nebo vědecká bariéra, která všechny tyto společnosti zastaví. Takže pokud je takového robota postavit možné s dnešní technologií, tak se to asi povede, protože to zkouší hodně lidí, mají hodně peněz a velkou motivaci uspět. Myslíme si, že druhá volba není moc pravděpodobná, což znamená, že se nám blíží robotická budoucnost, aniž by si toho lidé moc všímali!

🧬 AlphaFold 3 je venku

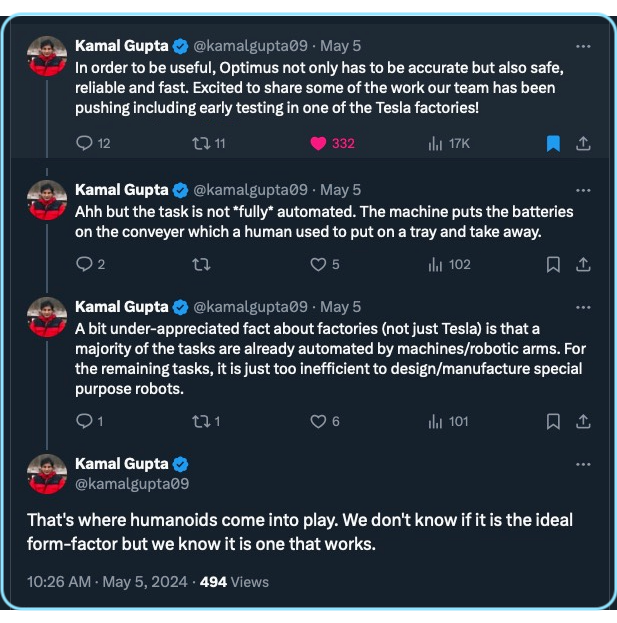

Google DeepMind vydal AlphaFold 3, novou verzi svého systému na skládání proteinů. Takzvaný problém skládání proteinů byl ještě během Standova vysokoškolského studia na Cambridge brán jako v podstatě neřešitelný oříšek. Jde o to, jak predikovat ze sekvence DNA, jaký tvar bude mít velká a komplikovaná molekula proteinu. Její tvar má obrovský dopad na funkci proteinu a je proto důležitou oblastí studia jak v biologii, tak i v medicíně. Nicméně jak naše matematické výpočty, tak naše simulace byly celé dekády na tento problém krátké a v podstatě nezaznamenaly jakékoli zlepšení.

DeepMind si vzal za cíl tento problém vyřešit a jejich první verze systému AlphaFold udělala relativně velký, ale stále ještě inkrementální pokrok. Velkým skokem byl ale AlphaFold 2 (skvělé video k němu zde), který v podstatě problém skládání proteinů vyřešil při přesnosti, která byla podobná typickým metodám rentgenové krystalografie používaným předtím. Velký rozdíl byl ale v tom, že zatímco předvídání tvaru jednoho proteinu často trvalo vysoce specializovanému člověku celý doktorát, tak AlphaFold 2 to samé zvládal v podstatě v reálné čase. Jsme si dosti jistí, že Demis Hassabis za něj jednou dostane (spolu) s týmem Nobelovu cenu🥇.

Třetí verze AlphaFold bude do 6 měsíců open source pro vědeckou komunitu, což jsou skvělé zprávy, a rozšiřuje predikce z proteinů na další biomolekuly. AlphaFold 3 také přímo generuje molekuly v interakci mezi sebou a to od velkých molekul, jako jsou proteiny, DNA a RNA, až po malé molekuly, na kterých jsou postaveny mnohé léky. Třetí verze taktéž nově využívá techniku difúze (diffusion), což je ve strojovém učení proces stojící třeba za obrázkovými generátory jako Stable Diffusion. DeepMind už nový AlphaFold 3 používá ve svém bio-pharma spin-offu Isomorphic Labs.

🙋 Dobrovolnost v AI regulaci

V oblasti regulace AI už se objevilo mnoho dobrovolných iniciativ, které se snaží přimět hlavní AI společnosti, jako jsou OpenAI, Anthropic či Google DeepMind, k naplňování různých závazků. Na britském summitu o bezpečnosti AI v Bletchley Park, který se konal loni v listopadu, došlo k příslibům, že tyto společnosti umožní britské vládě jejich modely testovat ještě před veřejným spuštěním. Jak ale informuje server Politico, jediná společnost, která umožnila britské vládě přístup k některým svým modelům před jejich zveřejněním, byla Google DeepMind.

Spoléhání se na dobrovolnou seberegulaci AI společností tak prokazatelně nepůsobí jako dobré řešení pro zajišťování bezpečnosti AI modelů a předcházení rizikům s nimi spojeným. V kontextu šibeničních termínů a snah jednotlivých firem ovládnout trh si totiž na další bezpečnostní testování nikdo nenajde čas. Jak jsme již zmiňovali, očekávaná nová britská vláda tak pravděpodobně představí závaznou regulaci týkající se AI.

🧈 Vtípek o Jensenovi

Na X/Twitteru jsme viděli super vtip na hranici AI a matematiky a taky vám ho jako správní killjoys vysvětlíme:

Jensen Huang je prezidentem společnosti NVIDIA, která vyrábí grafické karty a která je jednou z nejdůležitějších společností v AI, protože takzvaně “prodává lopaty” lidem, kteří za ženou za metaforickým zlatem umělé inteligence. Jensenova nerovnost (Jensen’s inequality), pojmenovaná po dánském matematikovi Johanovi Jensenovi je tvrzením o hodnotě funkce v průměru vs průměrné hodnotě funkce. Vtip spočívá v tom, že inquality je buď nerovností ekonomickou, nebo také matematickou. Zároveň se oba pánové jmenují Jensen (jeden tedy křestním jménem a druhý příjmením).

⚡Rychlé odkazy a myšlenky

⚔️ V minulém vydání newsletteru jsme se věnovali využití AI ve vojenském kontextu. Čínské snahy vybudovat své kapacity v této oblasti a využít AI k rychlé analýze dat i míření střel a identifikování cílů zajímavě popisuje tento článek.

🌟 Kde se koncentruje globální AI talent? To zjistíte na tomto webu s pěknými vizualizacemi. Smutnou zprávou je, že mezi top 25 institucemi s nejlepším AI výzkumem není ani jedna z Evropské unie (umístilo se jen švýcarské ETH).

🤌 Podle nového výzkumu společnosti Anthropic se s každou novou generací AI modelů zvyšuje jejich schopnost přesvědčovat (persuasiveness). Claude 3 Opus je tak podle jejich výsledků stejně přesvědčivý jako lidé!

🚗 Samořídící společnost Waymo (spadající pod Alphabet = “Google”) oznámila, že minulý týden překročila 50 000 platících zákazníků za týden. Relativně potichu se tak Waymo dostalo po malých krůčcích do stavu, kdy skeptici kolem samořídících auto budou muset uznat, že docela dobře fungují.

💬 Standa dával rozhovor do Respektu, který si můžete tento týden přečíst v tištěné formě i online. Mluvil také v panelu na Academia Film Olomouc (AFO) společně s několika vědci a vědkyněmi o AI a biologii. Zde je záznam ve formě podcastu.

Líbilo se vám osmnácté vydání newsletteru Pokrok v AI? Odebírejte ho přímo do vaší emailové schránky a podpořte tím naši práci!

Můžete ho také sdílet s přáteli na sociálních sítích.

Napsali Stanislav a Kristina Fort.

Díky za další novinky! Rád bych se zeptal, kde je to vyjádření DeepMindu ohledně budoucího open-sourcování AF3? V jednom panelu na ICLR se o tom v sobotu diskutovalo a panovalo přesvědčení, že si to komunita bude muset reimplementovat (což se prý již děje). Ale pokud bude časem k dispozici i originál, tak to bude samozřejmě super!