👋 Pokrok v AI – newsletter č. 20

Po delší odmlce píšeme o tom, jak vypadá nový evropský Úřad pro AI, jak (ne)funguje mezinárodní spolupráce na AI, o modelu, kterému o kousek uteklo zlato na olympiádě a o formách přemýšlení v LLMs.

Vítejte ve dvacátém vydání našeho newsletteru Pokrok v AI, ve kterém shrnujeme nejnovější poznatky a vývoj v oblasti používání umělé inteligence (AI), strojového učení (ML) a AI policy a regulace.

🇪🇺 Novinky z evropské AI Office

EU AI Office (či Úřad EU pro AI, my se budeme držet anglického názvu, který je nám bližší) byla oficiálně založena na konci května, ale detailnější informace o její struktuře a budoucím fungování se objevují postupně. Proto v tomto příspěvku chceme nastínit, co se zatím o této veledůležité instituci, která má za úkol koherentně implementovat unijní Akt o AI, ví.

Mnoho otazníků vyvstávalo ohledně toho, kdo tento úřad povede, protože jde o velmi důležité a strategické portfolio. Hodně se objevovalo jméno rumunského europoslance Dragose Tudaroche, který se Aktu o AI intenzivně věnoval a který svůj mandát v evropských volbách v červnu neobhajoval. Hlavou EU AI Office se ale nakonec stala italská úřednice Lucilla Sioli, která předtím působila jako ředitelka pro AI a digitální průmysl v Evropské komisi. Povede tak tým zhruba 140 lidí, které by měla EU AI Office ve své finální podobě zaměstnávat. Už proběhla první výběrová řízení zaměřená na technické experty a administrativní pracovníky a očekává se vypsání výběrového řízení pro politické experty.

Nedávno EU AI Office také vyzvala členské státy k doporučení tzv. sekundovaných národních expertů (SNE), což jsou převážně zaměstnanci národních úřadů vyslaní do Bruselu na omezené časové období. Toto oznámení vyvolalo určité spekulace, jestli je EU AI Office dostatečně financovaná, neboť sekundovaní národní experti by nebyli placeni z rozpočtu tohoto úřadu, ale jednotlivými členskými státy.

Dostatečné financování pro úřad, který povede unijní přístup k umělé inteligenci, je naprosto klíčové. Podle Tudarocheho by měla EU AI Office začínat s rozpočtem 46,5 milionu euro (zhruba 1,1 miliardy korun), což je méně než polovina rozpočtu britského Institutu pro bezpečnost AI (AI Safety Institute). To není úplně dobrý signál, protože EU AI Office bude mít výrazně více povinností než britský AI Safety Institute — má navíc například širokou škálu regulačních povinností.

Celá šíře agendy EU AI Office se odráží v její organizační struktuře. Ta sestává z pěti útvarů: oddělení pro regulaci a dodržování předpisů (Regulation and Compliance Unit), oddělení pro bezpečnost AI (Unit on AI safety), oddělení excelence v oblasti umělé inteligence a robotiky (Excellence in AI and Robotics Unit), oddělení pro společenský prospěch AI (AI for Societal Good Unit) a oddělení pro inovace a koordinaci politik v oblasti AI (AI Innovation and Policy Coordination Unit). Podle aktuálních informací by měl právě oddělení pro bezpečnost AI vést již zmiňovaný bývalý europoslanec Tudaroche. Další vývoj v EU AI Office pro vás budeme pravidelně sledovat.

🥇AI řeší mezinárodní matematickou olympiádu IMO

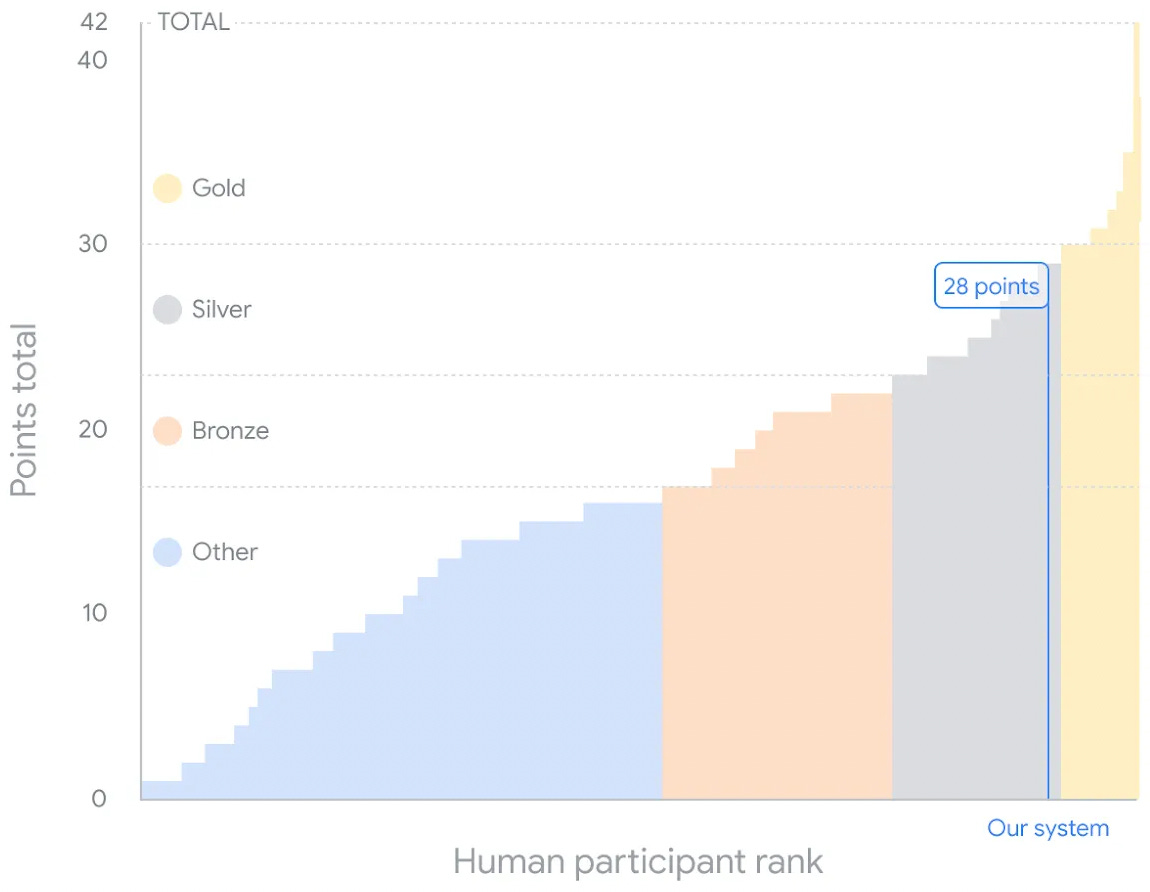

Výzkumná společnost Google DeepMind k překvapení mnohých oznámila, že její umělá inteligence AlphaProof získala ekvivalent stříbrné medaile na letošní Mezinárodní matematické olympiádě (International Mathematics Olympiad, IMO).

Její bodový zisk byl dokonce jen malý kousek pod medailí zlatou. (Na světových kolech předmětových olympiád se medaile udělují v pásmech, kde malá část nejlepších soutěžících dostane medaili zlatou. Soutěžící s celkově nejvyšším počtem bodů se pak nazývá absolutním vítězem.) To je obrovský úspěch! Pro lidi, kteří tvrdí, že umělá inteligence reálně nic neumí a jen vágně blábolí bez precizního přemýšlení, je tento výsledek dalším z řady velkých empirických problémů. V matematice se totiž blábolí velice obtížně a v té verzi matematiky, ve které pracoval AlphaProof (formální logické důkazy v jazyce Lean), je to více méně vyloučené.

V porovnání s vysokou stříbrnou medailí pro AlphaProof se můžeme podívat na výsledky nejlepších studentů a studentek vyslaných za Českou republiku. Český tým získal za poslední dekádu (2014 – 2024) 3 medaile zlaté, 15 stříbrných a 29 bronzových. To znamená, že i když ze všech středoškoláků v zemi vybereme toho nebo tu nejlepší, i jim se zlatou medaili podaří získat jen přibližně ve třetině případů.

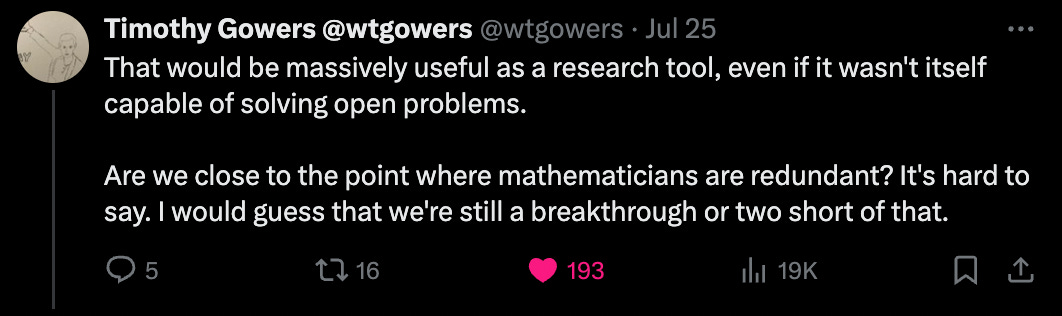

Tim Gowers, slavný matematik, profesor na univerzitě v Cambridge, nositel Fieldsovy medaile a sám absolutní vítěz Mezinárodní matematické olympiády (jejíž vítězství je silně prediktivní pro budoucí úspěch v profesionální matematice!) tweetoval o AlphaFold toho:

Ve volném překladu: Google DeepMind vytvořil program, který v jistém smyslu vykazuje výkon na úrovní stříbrné medaile na letošní Mezinárodní matematické olympiádě. Tento komentář ukazuje, že i pro člověka, který může být jedním z nejfundovanějších kritiků na světě, je AlphaProof legitimním úspěchem. Jeho kvalifikace “in a certain sense” souvisí nejspíše s několika rozdíly mezi běžným účastnictvem IMO a AlphaProof: 1) u některých úloh “přemýšlí” AlphaProof o hodně déle, než je alokovaný čas pro lidské účastníky (u některých úloh až 60 hodin, to se ale potenciálně dá vyřešit vyšším výpočetním výkonem pro AlphaProof), a 2) problémy musely být pro AlphaProof přeloženy z neformální lidské řeči do formálního důkazového jazyka jménem Lean. Přepis úloh do Leanu zkusil DeepMind udělat pomocí LLMs, ale nakonec některé z nich museli do-formalizovat lidé. Většinu matematického “heavy lifting” ale samozřejmě udělal AlphaProof.

Předchozí iterace matematické umělé inteligence ze společnosti DeepMind, o které jsme psali v předchozím vydání, se jmenovala AlphaGeometry, a jak jméno napovídá, řešila pouze geometrické problémy z IMO. Na nich se již tenkrát dokázala srovnávat s nejlepšími účastníky soutěže, což hodně lidí vnímalo jako vysokou metu. Nejlepší detailní komentář, který jsme k tomuto četli, se objevil na Redditu.

Ve své podstatě říká, že k řešení geometrických problémů používají účastníci několik veskrz algoritmických (= jednoduchých) postupů, ve kterých identifikují relevantní úhly v problému. Když se zaseknou, přidají do problému nový bod, jako je třeba střed úsečky mezi dvěma body, který už v problému existují, a pokračují. Samozřejmě pro člověka je takovýto postup nedostatečný kvůli jeho limitované paměti a časovému limitu, běhěm kterého by nestihl projít dostatečné množství možností. Na druhou stranu počítače jsou přesně v takovémto procházení možností dobré – přesně takto porazil DeepBlue Garyho Kasparova v roce 1997 v šachu a takovýto průzkum stromu (tree search) byl velkou součástí modelu AlphaGo, který porazil lidstvo ve hře Go v roce 2016 (skvělý dokument na YouTube). Nyní se zdá, že i težké matematické problémy se dají řešit takto jednoduchým způsobem, čehož AlphaGeometry výrazně využívá.

AlphaProof je o hodně obecnější systém než AlphaGeometry a v jeho řešeních je použita verze “strojové intuice” mnohem častěji. Výkon porovnatelný s vysokou stříbrnou a skoro zlatou medailí na Mezinárodní matematické olympiádě čekal takto brzy málokdo.

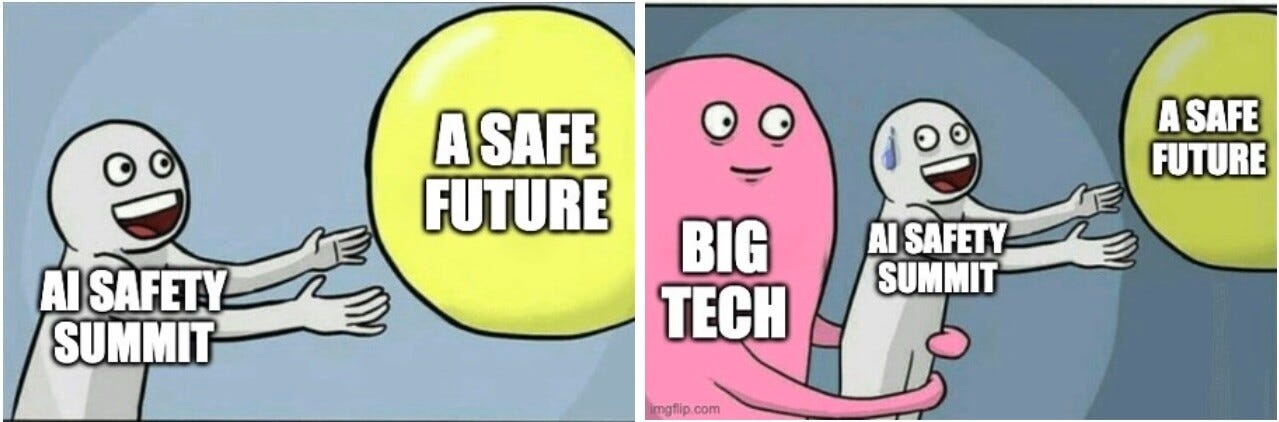

⛓️💥 Fragmentace mezinárodní spolupráce na AI

V tomto newsletteru často zmiňujeme různé mezinárodní iniciativy a instituce, které se snaží rozvíjet spolupráci v oblasti AI a pracovat na nastavování mezinárodně platných standardů. Pro ilustraci jen pár subjektů, které se aktuálně AI na mezinárodním poli aktivně věnují: G7, G20, Organizace pro hospodářskou spolupráci a rozvoj (OECD), Organizace OSN pro vzdělání, vědu a kulturu (UNESCO), Organizace spojených národů (OSN), Mezinárodní telekomunikační unie (ITU), Rada Evropy, Africká unie (AU) a další.

To přirozeně vede k vysoké míře fragmentace. Každá z těchto institucí se snaží vytvořit vlastní pravidla pro AI. Když ale existuje mnoho různých pravidel, neplatí ve finále žádná. To umožňuje technologickým firmám vybírat si, která pravidla budou respektovat a s kým budou spolupracovat. Jen málokterá pravidla jsou totiž reálně závazná. Tento příspěvek nemá za cíl volat po likvidaci některých institucí, ale spíš upozornit na to, že je nutné odrazovat od dalších dobrovolných iniciativ, ale spíš zavádět závazné efektivní regulační mechanismy a vyvíjet univerzální standardy, kterými se budou (skoro) všichni řídit — tak jak to funguje v dalších odvětvích lidské činnosti, ať už se jedná o léčiva či leteckou dopravu.

🧠 Rozličné způsoby toho, jak mohou digitální mysli něco “vědět”

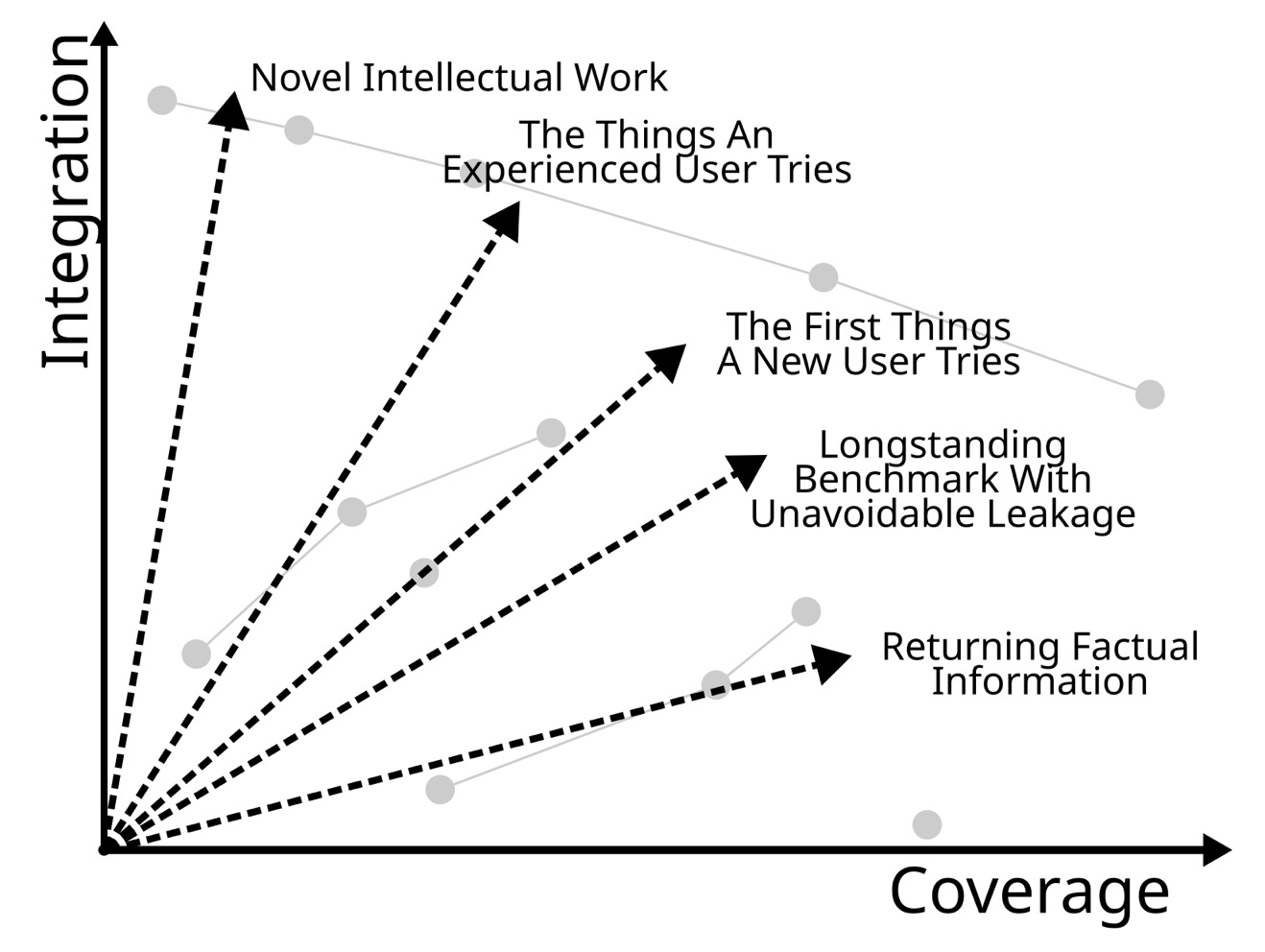

Nedávno jsme četli jednu z nejlepších esejí na téma, které bylo středobodem mnohých diskuzí kolem umělé inteligence po tom, co ChatGPT vstoupil jako blesk z čistého nebe z počítačů a datových center výzkumníků do všedního života lidí po celém světě rok a tři čtvrtě zpátky (toto letí): Jak může jazykový model něco vědět?

Mezi skeptiky se objevovaly různé metafory, které měly “dokázat”, že jazykové modely “doopravdy” nepřemýšlí. Například slavný sci-fi autor Ted Chiang (podle jehož předlohy byl natočen například film Arrival) napsal ve svém článku v magazínu New Yorker, že ChatGPT je “rozmazaný obrázek webu” (“a blurry JPEG of the web”), zatímco čtveřice relativně prominentních výzkumnic je ve svém článku z roku 2021 označila za “náhodné papoušky” (“stochastic parrots”). Na druhé straně máme článek od Microsoftu z roku 2023, v němž výzkumníci, kteří testovali rannou verzi GPT-4, tvrdí, že GPT-4 obsahuje “záblesky obecné umělé inteligence” (“sparks of AGI”).

Na první pohled by se mohlo zdát, že jsou tyto dvě pozice v přímém rozporu: “jazykové modely si toho jen hodně pamatují a recitují nám to zpátky” vs “jazykové modely doopravdy přemýšlí”. Esej The Many Ways that Digital Minds Can Know (volným překladem “Mnoho cest, jak mohou digitální mysli vědět”), představuje komplementární pohled, ve kterém mohou být obě tyto pozice pravdivé zároveň a to do různé míry.

Její hlavní tvrzení jsou:

Velké jazykové modely dělají jak to, co říkají jejich skeptici, tak to, co říkají jejich příznivci.

Dělají oboje zároveň v reakci na jakýkoliv jednotlivý prompt.

Je velice težké tyto dvě formy “vědění” z venku (bez analýzy signálů šířících se uvnitř jazykovým modelem) rozlišit.

Ale obě dvě formy vědění jsou užitečné.

Pokud vás zajímá detailnější pohled na znalosti a přemýšlení LLMs, než který můžete typicky slyšet v diskuzích (bohužel i od “odborníků”), určitě si tuto esej přečtěte — je velice přístupná a relativně krátká.

🇨🇿 Česko aktualizovalo Národní strategii umělé inteligence 2030

Koncem července česká vláda schválila aktualizovanou Národní strategii umělé inteligence (NAIS), která se věnuje prioritám a cílům v této oblasti. Definuje sedm hlavních oblastí, v rámci nichž se Česká republika má AI věnovat: (1) výzkum vývoj a inovace, (2) vzdělávání a odborná příprava, (3) dovednosti a dopady AI na trh práce, (4) etické a právní aspekty, (5) bezpečnostní aspekty, (6) průmysl a podnikání a (7) veřejná správa a veřejné služby. Na tuto iniciativu by měl navázat Akční plán, který by strategii uvedl do praxe mimo jiné díky investicím až do výše 19 miliard korun.

Je skvělé, že vláda vyjádřila o téma umělé inteligence zájem. Zároveň si ceníme toho, že se aktualizovaná strategie věnuje zapojování AI do veřejné správy a služeb, neboť má velký potenciál procesy ve veřejné správě zefektivnit. Naskakování do rozjetého vlaku se strategií, která má tolik odlišných priorit, ale z Česka velmi pravděpodobně AI lídra neudělá (na to nám také chybí i lidský kapitál). Z dlouhodobého hlediska by tak bylo rozumnější konzistentně investovat do vzdělávání a zreformovat český vysokoškolský a vědecký systém tak, aby se stal konkurenceschopnějším, než se snažit dohnat nedohnatelné a investice rozpustit v mnoha oblastech tak, že nebudou mít reálný dopad.

⚡Rychlé odkazy a myšlenky

🇺🇳 Na konci května jsme se zúčastnili konference AI for Good v Ženevě. Kristina o tom napsala blogový příspěvek (v angličtině), přečíst si ho můžete zde.

💬 Standa přednášel na Human-Aligned AI Summer School v Praze na téma Adversarial attacks as a laboratory for AI alignment

💭 Co si Američané myslí o AI? To se dozvíte z tohoto průzkumu. Můžeme ale prozradit, že téměř 6 z 10 Američanů tvrdí, že se po nedávné demonstraci a vydání GPT-4o společnosti OpenAI více obávají rozvoje umělé inteligence.

💰 Velká Británie oznámila nový grantový balíček na financování výzkumu v oblasti AI bezpečnosti na úrovni komplexních systémů. Investuje do něj 8,5 milionu liber (téměř 300 milionů korun).

🤝 Mezi mezinárodní organizace, které se o AI zajímají, patří i NATO, která nedávno vydala svoji zrevidovanou strategii pro umělou inteligenci. Věnuje se v ní například bezpečnostním rizikům spojeným s AI i zrychlování “zodpovědného přijímání” AI dovedností tak, aby z nich Severoatlantická aliance mohla benefitovat.

文 Google přidal 110 nových jazyků do svého překladače Google Translate za pomoci velkého jazykového modelu PaLM 2, který vyvinul. Nově přidané jazyky zvyšují počet lidí, jejichž jazyky překladač pokrývá, o dalších 600 milionů.

🇪🇺 Čemu by se měla věnovat nová Evropská komise? Podle tohoto článku by třeba měla začít nový panevropský výzkumný program pro bezpečnost AI a přispět tak k rozvoji vědy věnující se vývoji bezpečných obecných AI systémů.

Líbilo se vám dvacáté vydání newsletteru Pokrok v AI? Odebírejte ho přímo do vaší emailové schránky a podpořte tím naši práci!

Můžete ho také sdílet s přáteli na sociálních sítích. Jsme vděční za každé sdílení!

Napsali Stanislav a Kristina Fort.