👋 Pokrok v AI – newsletter č. 23

Tentokrát se věnujeme Nobelovým cenám, Institutům pro bezpečnost AI, modulárním reaktorům i vývoji kolem Aktu o AI a přinášíme i speciální pozvánku – již tento pátek!

Vítejte ve dvacátém třetím vydání našeho newsletteru Pokrok v AI, ve kterém shrnujeme nejnovější poznatky a vývoj v oblasti používání umělé inteligence (AI), strojového učení (ML) a AI policy a regulace.

🥇 Nobelovy ceny pro AI

Nobelovy ceny byly letos poprvé (a skoro určitě ne naposledy) plné umělé inteligence. Cenu za fyziku vyhráli Geoffrey Hinton a John Hopfield za svůj výzkum umělých neuronových sítí jako modelu asociativní paměti. Cenu ze chemii vyhráli Demis Hassabis a John Jumper za systém AlphaFold, společně s Davidem Bakerem za jeho dlouhodobý výzkum problému skládání proteinů.

Geoffrey Hinton, plným jménem Geoffrey Everest Hinton, má zajímavou kariéru a ještě zajímavější rodokmen. Jeho středí jméno, Everest, se s nejvyšší horou světa neshoduje náhodou — získal ho po svém pra-pradědovi Georgy Everestovi, který byl hlavním geografem Indie pod Britskou koloniální správou a po němž je hora Mount Everest pojmenovaná. Jeho druhým pra-pradědou je George Boole, slavný matematický logik, po němž se dnes jmenuje v mnoha programovacích jazycích logický datový typ boolean nebo bool. Jeho prastrýc Charles Hinton v angličtině zavedl slovo tesseract pro 4D zobecnění krychle, jeho pra-prababička Alicia Boole Stott zavedla v matematice slovo polytop a jeho strýc Colin Clark zase přišel s využitím hrubého národního produktu v ekonomii. Svým nynějším úspěchem tak navazuje na dlouhou působivou rodinnou historii.

John Hopfield přišel s tak zvanými Hopfieldovými sítěmi. Jde o model asociativní paměti, ve kterém se vyskytují neurony, které jsou propojeny každý s každým (na rozdíl od dnešních neuronových sítí, u kterých jsou neurony uspořádány do vrstev). Tato síť je v podstatě modelem fyzikálního systému, ve kterém síla propojení mezi neurony určuje, nakolik chtějí být zapnuty nebo vypnuty spolu. “Vzpomínky” se z této paměti získávají tak, že na několik vybraných neuronů vložíme hodnoty odpovídající například zašumělému nebo neúplnému obrázku kočky a necháme systém dynamicky vyvinout tak, aby minimalizoval svoji energii — tak, jak se ve fyzice systémy běžně samy vyvíjejí, viz třeba kámen padající k zemi, snažící se minimalizovat svoji potenciální energii.

Tím, že síť nejprve nastavíme tak, aby minima energie odpovídala uloženým vzpomínkám (například pixelům obrázků koček), zajistíme, že i neúplná verze obrázku způsobí usazení se ve stavu sítě, které reprezentuje obrázek čistý. Způsob, kterým se do sítě vzpomínky ukládají, se jmenuje Hebbovské učení (Hebbian learning) a jde o biologicky realističtějšího, ale o hodně méně efektivního předchůdce dnešních, na backpropagaci postavených, učících algoritmů.

Geoff Hinton tuto architekturu zlepšil a představil takzvané Boltzmann machines. Největší popularity se ale dostalo jejich zjednodušené verzi jménem Restricted Boltzmann Machines, které už neměly neurony propojené každý s každým, ale poskládané do vrstev tak, jak jsme dneska zvyklí. To těmto sítím umožnilo naučit se již tak dobře známou hierarchickou strukturu dat, na kterých trénovaly — dnes víme, že první vrstvy v jazykovém modelu nebo klasifikátoru obrázku se soustředí na jednoduché vzorce, jako jsou orientované hrany nebo skupinky pixelů, a čím hlouběji do sítě jdeme, tím abstraktnější vzorce neurony reprezentují. Prvním krokem v tomto směru byly právě Hintonovy Restricted Boltzmann Machines.

Nobelovu cenu za chemii si odnesli tři vědci, kteří pracovali na problému skládání proteinů, což byla jedna z největších a nejnevyřešitelnějších otázek strukturální biologie. Ve zkratce jde o to, jak určit tvar proteinu (velké, komplikované molekuly, která je důležitá pro skoro všechno v biologii) z jejího popisu jako sekvence písmen DNA. Počítače s tímto měly veliké problémy a ještě v době, kdy Standa studoval, byl tento problém brán jako nevyřešitelný. Ukázalo se ale, že tým 20 dedikovaných (povětšinou) ne-biologů + AI + velký výpočetní výkon byl receptem na úspěch a když AlphaFold 2 (dobré video o AlphaFold) vyhrál v roce 2021 soutěž CASP14 s predikcemi často nad úrovní experimentálních metod (a vysoce nad úrovní ostatních modelů), bylo nám jasné, že Nobelova cena je na cestě. Určitě jsme ji ale nečekali již za 3 roky! Takovýto typ pokroku — ve kterém AI posouvá hranice našeho poznání fundamentálních věd — je něco, k čemu hodně lidí v AI aspirovalo a aspiruje. Je skvělé vidět, že se to konečně stává realitou.

🇪🇺 Co chybí Aktu o AI?

V létě jsme vás informovali o tom, že Akt o AI oficiálně vstoupil v platnost, byť některé jeho části začnou platit až s odstupem. Právě proto jsme se v dnešním vydání rozhodli zaměřit na jednu důležitou část Aktu o AI, která se teprve vyvíjí, a to je Kodex správné praxe (neboli Code of Practice), který má specifikovat povinnosti pro poskytovatele obecných modelů AI. Jedná se tedy o klíčovou část Aktu o AI, která ale aktuálně neexistuje.

Finální verze kodexu správné praxe by měla být zveřejněna v dubnu 2025 a je tak nejvyšší čas začít na nich pracovat. Právě proto nedávno Evropská komise představila čtyři pracovní skupiny a jejich předsednictvo, které bude za tuto významou část Aktu o AI zodpovědné. Tyto pracovní skupiny se budou věnovat čtyřem tématům: (1) transparentnosti a pravidlům spojeným s autorskými právy, (2) identifikaci a zhodnocení rizik (včetně evaluací), (3) technickému zmírňování rizik a (4) internímu řízení rizik a správě poskytovatelů obecné umělé inteligence.

Vzhledem k důležitosti tohoto dokumentu jsme moc rádi, že při výběru členstva předsednictva Evropská komise sáhla mimo svoje řady do světa opravdových expertů na toto téma. Obzvlášť pracovní skupiny 3 a 4 mají vskutku pěkné obsazení a jsme tak rádi, že k tvorbě kodexu správné praxe přispějí lidé s bohatými dlouholetými zkušenostmi v oblasti AI. To je opravdu dobrá zpráva pro Evropu.

☢️ Google kupuje modulární reaktory

Společnost Alphabet (majitel Googlu) oznámila, že nakoupí elektrickou energii generovanou sérií malých modulárních reaktorů, kterou pro ni postaví společnost Kairos Power. Podobně jako předtím Microsoft, tak i Alphabet se nyní vrací zpátky k čisté energii z jaderného štěpení, aby pokryla energetickou spotřebu svých datových center, ve kterých se, mimo jiné, trénuje umělá inteligence.

V počáteční fázi je v plánu do roku 2030 začít dodávat energii z prvních modulárních reaktorů, další reaktory se přidají do roku 2035. Celkově by se mělo jednat o 500 MW (to je asi jedna čtvrtina kapacity českého Temelína) prakticky bezemisní elektrické energie dostupné 24 hodin denně, 7 dní v týdnu.

Jaderná energie má, hlavně díky svému historickému propojení s jadernými zbraněmi, (podle nás) nezaslouženě špatnou reputaci mezi environmentalisty a lidmi, kteří bojují proti globální změně klimatu. V pravdě se ale jedná o zdroj, jehož emise skleníkových plynů na jednotku energie jsou podle mnohých odhadů dokonce ještě nižší než pro solární, větrné, nebo vodní elektrárny.

Podle Mezivládního panelu pro klimatickou změnu (IPCC, Intergovernmental Panel on Climate Change) a jeho všeobecně uznávané každoroční zprávy o stavu klimatu jsou emise z jaderné energie přibližně 12 gramů CO2 na kilowatt-hodinu (to zahrnuje vše od těžby uranu až po odstavení elektrárny na konci životnosti). Pro solární energii ta samá zpráva odhaduje 48 gramů (jiné zprávy se dostávají ke 30 gramům), což je pořád výrazně více než emise z jaderné energetiky. Obě tyto možnosti jsou ale absolutně úžasné v porovnání s uhlím (800 až 1000 gramů CO2) a dokonce i zemním plynem (400 až 500 gramů), kterým bohužel například Německo nahradilo po roce 2011 své jaderné zdroje v něčem, co se nedá vnímat jinak než ekonomická a environmentální rituální sebevražda.

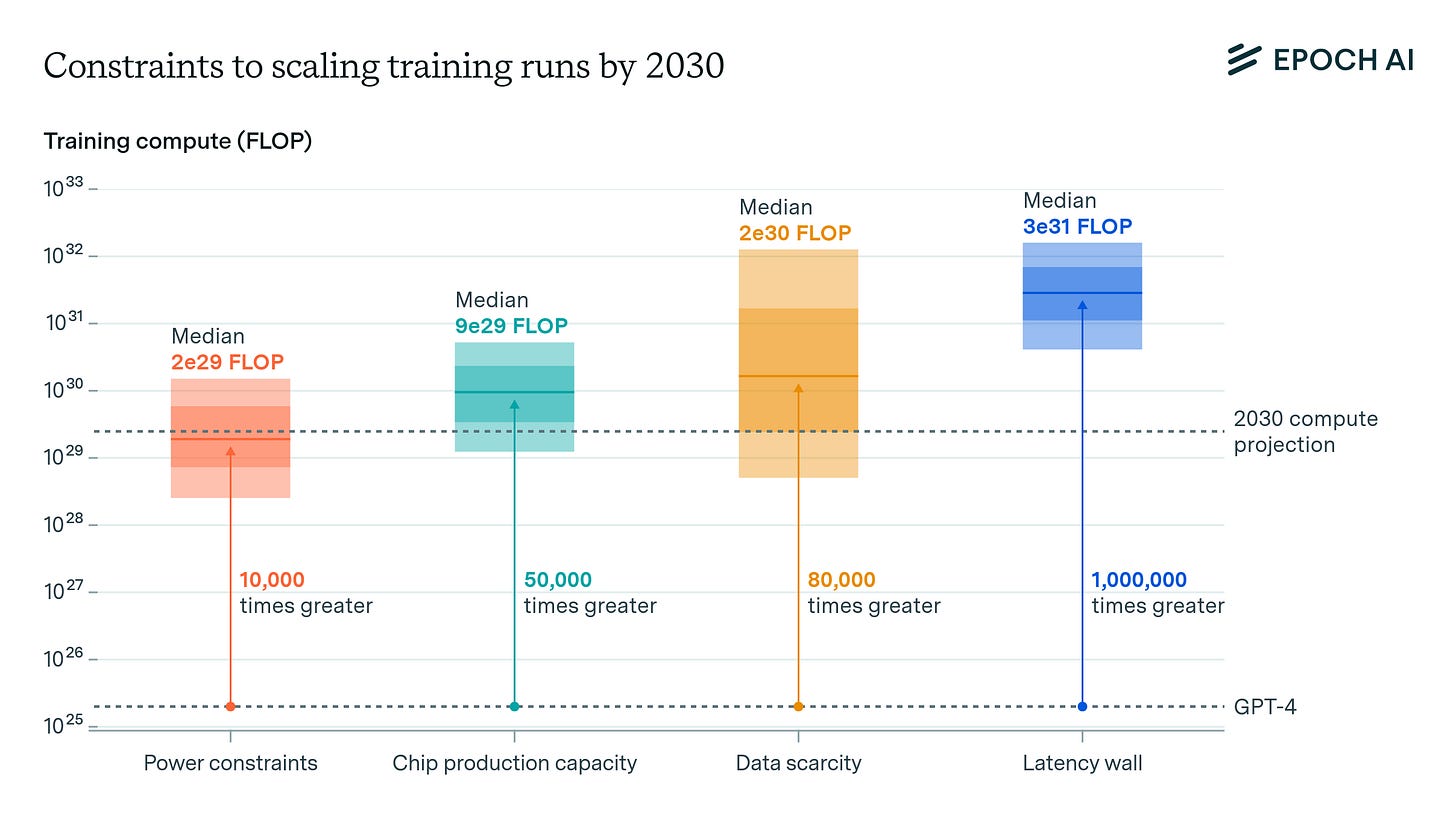

Návrat velkých technologických firem v USA k jaderným zdrojů tedy dává jak environmentální, tak spolehlivě i ekonomický smysl — jsou to přeci jen veřejně obchodované firmy. Podle výzkumné skupiny Epoch AI, která se snaží předvídat budoucí trendy ve vývoji umělé inteligence, jsou energetické nároky největším potenciálním problémem pro modely nad úrovní hypotetického GPT-5. Rozhodnutí Microsoftu i Alphabet vsadit si na jaderné zdroje v dalších 5 až 10 letech tedy nejspíše zvyšuje šance, že se takových modelů jednou dočkáme.

🔥 Quo vadis Instituty pro bezpečnost AI

Co se mezinárodního dění kolem AI týče, poslední dva týdny byly relativně klidné, a proto bychom se v tomto newsletteru chtěli zaměřit na instituce, které jsou poměrně důležité, ale zatím jsme se jim nevěnovali příliš v detailu – Instituty pro bezpečnost AI (AI Safety Institutes – AISIs).

Kristině a jejím spoluautorům vyšel nedávno report o “první vlně” těchto institutů, kam zařadili AISIs v Británii, USA a Japonsku. Tyto AISIs první vlny mají několik společných charakteristik: všechno to jsou technické vládní instituce, mají jasný mandát zaměřený na bezpečnost AI a nemají žádné regulační pravomoci. Zároveň se věnují třem hlavním okruhům činnosti: výzkumu, standardům a spolupráci. Všechny tyto aktivity spojuje téma evaluací, tedy hodnocení AI systémů, na které se aktuálně AISIs spoustředí nejvíce.

S blížícím se AI summitem ve Francii, o kterém jsme psali tady, vyvstává otázka, jak vypadá budoucnost těchto institutů. Na předchozím summitu v Seoulu se deset států a Evropská unie zavázaly, že založí vlastní AISI nebo obdobnou instituci a že vytvoří mezinárodní síť těchto institutů, k čemuž zatím nedošlo. Nedávno ale oznámila americká ministryně pro obchod Gina Raimondo, že má k inauguračnímu setkání existujících AISIs dojít letos v druhé polovině listopadu v San Franciscu, což rozhodně budeme podrobně sledovat. Zajímavostí je, že se přestože mezi původní signatáře seoulské deklarace patří Německo, tohoto setkání se podle aktuálních informací nezúčastní, zato se k němu přidá Keňa. O průběhu jednání vás určitě budeme informovat v dalších vydáních!

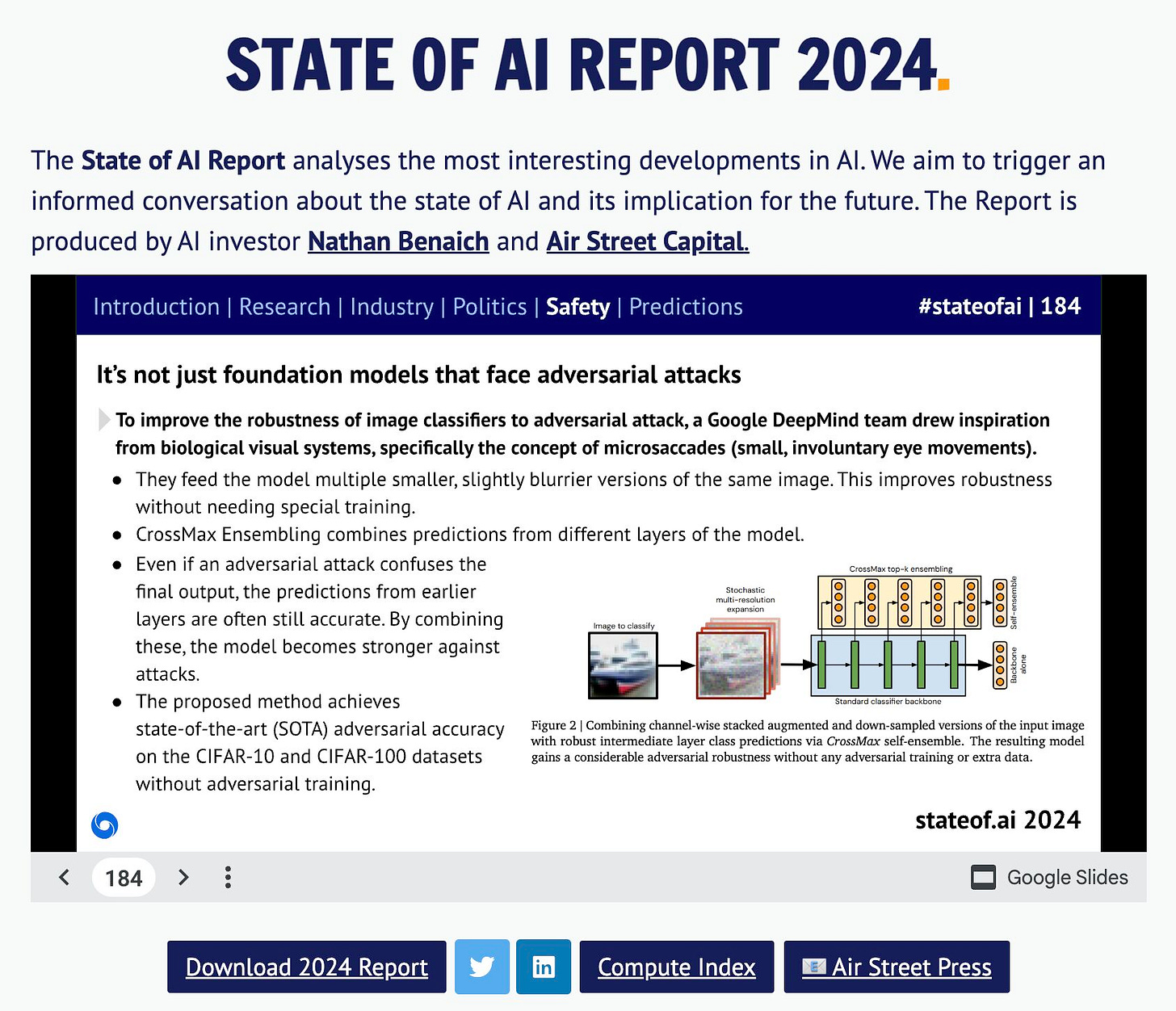

📅 State of AI Report 2024

Už tradičně letos vyšel State of AI Report, tentokrát pro rok 2024, který tvoří AI investor Nathan Benaich a venture capital (VC) společnost Air Street Capital. Na 200 slidech rekapitulují vývoj umělé inteligence za poslední rok od investic, startupů, až po výzkum a regulaci. Naše osobní spojení letos je, že Standův vědecký projekt Ensemble everything everywhere: Multi-scale aggregation for adversarial robustness, který založil a vedl v Google DeepMind, byl vyzdvižený celostránkovým pokrytím v rámci sekce bezpečnosti AI. V rámci článku se Standovi podařilo z velké části vyřešit 10 let trvající problém takzvaných adversariálních útoků na neuronové sítě.

⚡Rychlé odkazy a myšlenky

👋 Kristinu i Standu můžete 18. října 2024 od 19:00 potkat na dalším cyklu popularizačních přednášek Žárovky: Kristina bude přednášet o Institutech pro bezpečnost AI a Standa o adversariálních útocích na neuronové sítě a bezpečnosti AI. Registrace je zde.

🎊 Náš newsletter nedávno překonal hranici 1000 odběratelů, díky, že jste tu s námi!

🎙️Standa mluvil v podcastu Respektu o svém výzkumu umělé inteligence a o tom, jak spolu souvisí statistická fyzika a neuronové sítě.

Líbilo se vám dvacáté třetí vydání newsletteru Pokrok v AI? Odebírejte ho přímo do vaší emailové schránky a podpořte tím naši práci!

Můžete ho také sdílet s přáteli na sociálních sítích. Jsme vděční za každé sdílení!

Napsali Stanislav a Kristina Fort.