👋 Pokrok v AI – newsletter č. 24

Toto vydání našeho newsletteru přináší mozky mušek, závody, šachy i agenty, tak se pusťte do toho.

Vítejte ve dvacátém čtvrtém vydání našeho newsletteru Pokrok v AI, ve kterém shrnujeme nejnovější poznatky a vývoj v oblasti používání umělé inteligence (AI), strojového učení (ML) a AI policy a regulace.

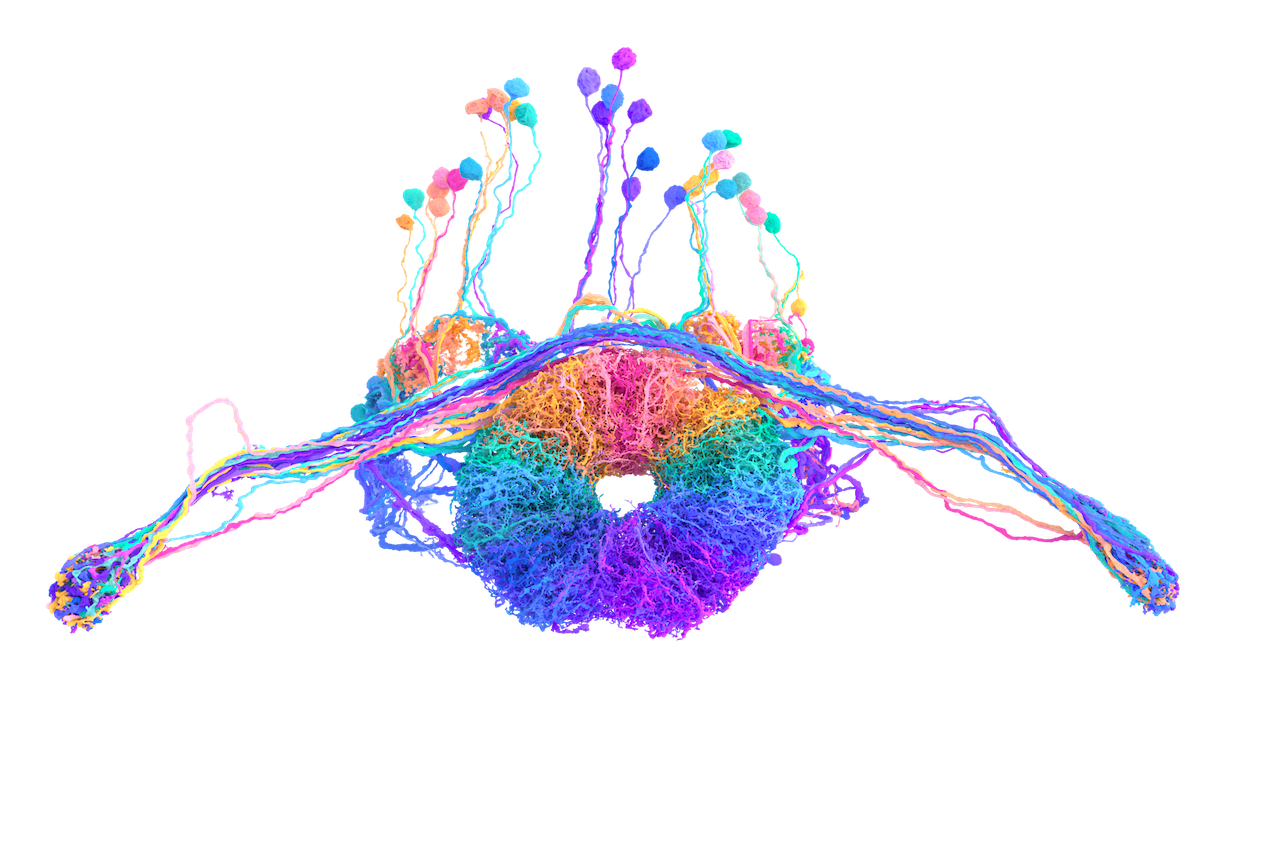

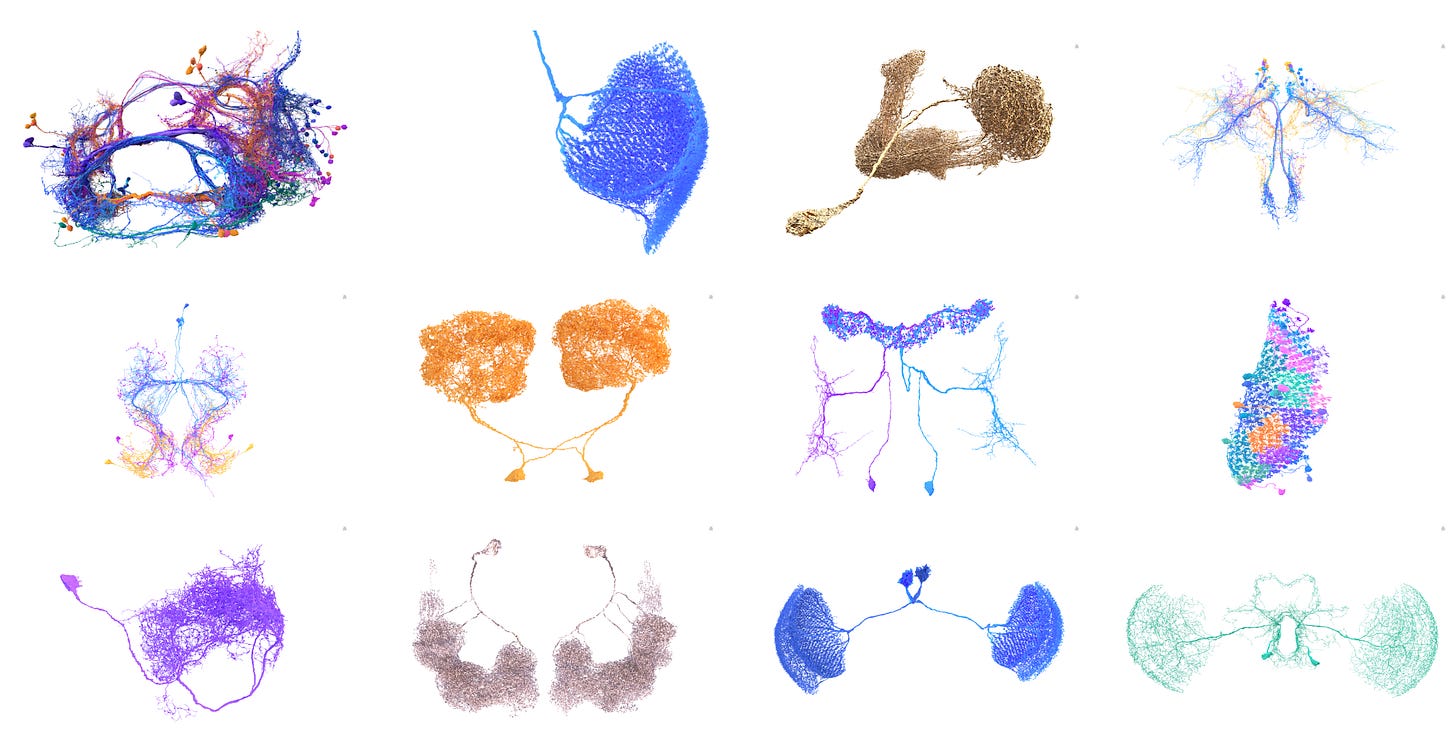

🪰 Naskenovali jsme celý mozek mušky

Octomilka obecná (latinsky Drosophila melanogaster) je malá muška, která se ale těší obří popularitě ve vědě. Její životní cyklus je pouze 10 dní dlouhý, snadno se chová v laboratořích, sdílí 60 % genů s lidmi, má hodně dětí a její biologické procesy jsou hodně podobné lidským. To z ní dělá ideální modelový organismus pro výzkum všeho možného.

Nyní velká kolaborace jménem FlyWire Brain (vzešlá z Princeton University) publikovala kompletní konektom jedné octomilky — všech 140 000 neuronů a 50 000 000 synapsí. Máme tak k dispozici přesné zapojení mozku jednoho konkrétního zástupce této mušky. Mohlo by se zdát, že v principu můžeme tuhle mušku “uploadovat” do počítače a nechat ji žít v simulované realitě tak, jak o tom už dekády uvažují futuristé a transhumanisté (v transhumanismu se nahrávání myslí do počítače bere jako forma prodloužení života a nesmrtelnosti — taktéž občas nazývána digitální nesmrtelností). Problém je, že znát propojení všech neuronů nestačí!

Znát takzvaný konektom — tedy každé propojení mezi všemi neurony — je nedostatečné k tomu, abychom dokázali nasimulovat chování odpovídající neuronové sítě. Například konektom takzvaného háďátka (latinsky C. elegans) jsme znali už od roku 1986 a to hlavně proto, že tento malý tvoreček má pouze 302 neuronů (v porovnání se stovkou miliard neuronů v mozku lidském). I tak se nám ale zatím nepodařilo háďátko “rozběhnout” v simulaci.

Znalosti propojení neuronů totiž odpovídají více méně pouze architektuře neuronové sítě. To, jaký “program” je v ní uložený, závisí u umělých neuronových sítí na vahách propojení a u biologických sítí na velkém množství detailů, které neumíme dobře změřit a možná zatím ani neznáme. Tudíž to, co získáme, je v podstatě neuronová síť před svým tréninkem, tedy bez jakýchkoli uložených znalostí nebo vzorců chování. Věda má před sebou ještě velký kus cesty, než se nám mozky i těch nejmenších organismů podaří spustit v simulovaných digitálních realitách, takže pokud váš životní plán obsahuje uploadování do simulace, určitě si ještě chvíli budete muset počkat.

🏁 Závod o dosažení AGI

V říjnu vydal CEO a spoluzakladatel společnosti Anthropic Dario Amodei esej Machines of Loving Grace (neboli Stroje láskyplné milosti), která má za cíl představit možné pozitivní dopady umělé inteligence na náš svět, ať už v oblasti biologického výzkumu či zvyšování kvality života. Tato esej se okamžitě stala hojně skloňovaným textem v AI komunitě. Kromě benefitů, které AI podle Amodeie světu přinese, autor odkazoval také k nutné dominanci “Západu” nad obecnou umělou inteligencí (AGI).

To, kdo ovládne AGI, je aktuálně poměrně velkým tématem nejen v komunitě zaměřené na AI bezpečnost, ale i některých vládních kruzích. O tom, že Spojené státy musí kontrolovat AGI, psal už na začátku tohoto roku Leopold Aschenbrenner ve své eseji Situational Awareness, která předpovídá znárodnění AI průmyslu americkou vládou (podle něj mezi lety 2027-2028). Před narativem zaměřeným na závod k co nejschopnější umělé inteligenci a dominanci nad AGI někteří výzkumníci i aktivisté varují a volají po inkluzivnějším, optimističtějším, multilaterálním přístupu k budoucnosti AI.

Perspektiva zaměřená na závod o rozvoj AI mezi Spojenými státy a Čínou totiž nutně vede k adversariálnímu technologickému zbrojení a přehlíží vývoj mimo tyto dva státy. Nedávný článek v prestižním časopise Foreign Affairs upozorňoval na nutnost jednat se státy Blízkého východu, které mají dobré předpoklady (ať už finanční či energetické) pro úspěch v AI. Ve svém nedávném článku je Kristina označila jako “third places”, tedy metaforická třetí místa, která sice nejsou lídry v oblasti AI, ale mohou výrazně ovlivnit její další směřování. I proto je nutné nedívat se na současnou geopolitickou situaci kolem umělé inteligence jen prizmatem bipolárního závodu, ale dát šanci spolupráci. AGI bude nutně závislá na dodavatelských řetězcích procházejících různými státy, ať už kvůli fyzické infrastruktuře či energetické náročnosti, a tak je nutné místo závodu v izolaci budovat nová partnerství.

♟️ Šachy bez pohledu do budoucnosti

Google DeepMind publikoval článek Grandmaster-Level Chess Without Search (v překladu: Šachy na úrovni velmistrů bez vyhledávání). V rámci něj autoři ukázali, že transformer (typ zapojení neuronů v umělé neuronové síti) s pouhými 270M parametry může získat schopnosti, které jsou typicky dostupné pouze modelům, které kombinují ohodnocování šachovnic společně s obrovským a výpočetně náročným průzkumem budoucích vývojů hry. Transformer v tomto článku má přitom přibližně 500x méně parametrů, než mělo původní GPT-3, a 1000x méně, než největší LLaMa-3. Učí se pouze predikci dalšího pohybu na šachovnici – nepoužívá žádný průzkum. V jistém smyslu se tedy nedívá “do budoucnosti” hry, ale jen “intuitivně” provede další tah.

Tento výsledek je důležitý, protože lidé často říkají, že LLMs nemůžou plánovat, protože vždy predikují jen další token. Zde ale máme model, který hraje šachy na úrovni velmistra, aniž by jakékoli explicitní plánování dělal. Buď tedy musíme usoudit, že v šachách plánování není nutné, nebo že model, v rámci na první pohled jednoduché predikce dalšího tokenu, plánování interně a implicitně provádí.

Lidé byli v šachách definitivně sesazeni z trůnu v roce 1997 počítačem a programem IBM Deep Blue, které porazil úspěšného šachistu Garryho Kasparova ve slavném turnaji, jenž je velkým milníkem ve vývoji umělé inteligence.

Typický program na hraní šachů (ale i jiných deskových her, jako je obtížnější Go) má dvě klíčové části: 1) hodnotící funkci, která se podívá na desku a rozložení figurek a odhadne, jak dobrá je to pozice a 2) funkci průzkumu stromu budoucích možností. IBM Deep Blue vyhrál hlavně díky obrovskému výpočetnímu výkonu, který mu umožnil projít nelidské množství budoucích stavů hry. I nejlepší šachoví hráči “nevidí do budoucnosti” tak daleko, jako program Deep Blue. To, co jim ale dává výhodu, je jejich výrazně lepší “intuice”, tedy schopnost podívat se na desku a odhadnout na základě zkušeností, jak perspektivní je. V této schopnosti nebyl Deep Blue nikdy moc dobrý.

Program z dílny DeepMind jménem AlphaGo (na YouTube je o něm skvělý dokument), který v roce 2015 nejprve porazil evropského šampiona jménem Fan Hui a v roce 2016 i světového šampiona Lee Sedola, byl pro celý svět překvapení, protože narozdíl od šachů je v Go o hodně těžší prozkoumávat manuálně budoucí možnosti vývoje hry — zatímco typická pozice v šachách má 30-40 možných kroků k prozkoumání, Go jich má typicky 200-300. Proto lidé v Go vyhrávali o tolik déle než v šachách — počítače nebyly výpočetně schopny vidět dostatečně daleko do budoucnosti a hodnota lidské intuice v ohodnocování stavu hry byla pro ně nedosažitelná. To však změnil program AlphaGo tím, že pomocí hlubokých neuronových sítí strojový ekvivalent této intuice získal.

Příběh, ve kterém počítače získávaly čím dál tím lepší schopnost “cítit”, jak dobrý stav hry zrovna vidí, pokračoval k AlphaZero, které poráželo nejlepší šachové programy na světě a to vše se 100x menším počtem budoucích scénářů, které explicitně procházelo ve svém průzkumu možných her. Článek Grandmaster-Level Chess Without Search vede tento přístup do extrému — počítač se zde vůbec nedívá do budoucnosti. Jen se podívá na desku a udělá, co mu přijde jako “intuitivně” nejlepší krok. I přesto ale získává úroveň velmistra.

🥷 Co chtějí AI agenti?

Společnost Anthropic představila novou verzi svého modelu Claude 3.5, která nyní dokáže sama používat počítač. Umí tedy psát text, pohybovat myší i sledovat obrazovku. Jde o další milník v rozvoji velkých jazykových modelů (LLMs), který je jak se zdá pokořen, a otevírá tak dveře éře AI agentů, což je v posledních měsících jedno z nejskloňovanějších témat v oblasti umělé inteligence (a to nejen v pitch decks = v žádostech o investice do nových start-upů).

AI agenti (AI agents) jsou definováni jako AI systémy, které dokáží splnit určité úkoly autonomně bez lidské pomoci. Právě tato technologie pravděpodobně začne mít vskutku revoluční dopad na trh práce, neboť umožní automatizaci různých (obzvlášť monotónních) úkolů bez zásahu člověka. Očekává se, že AI agenti budou v blízké budoucnosti schopni plnit komplexní úkoly s otevřenými otázkami, a tak se pravděpodobně dostanou i k důležitějším problémům s větším dopadem (jako rozhodování v různých kontextech), což nutně přinese další rizika.

Proto někteří výzkumníci, jako Alan Chan, zdůrazňují důležitost opatření zaměřených na vizibilitu, tedy vidění do jejich chování. Podle něj by se o toto měli snažit především poskytovatelé AI agentů a vizibilitu by měli zajišťovat především díky identifikátorům jednotlivých agentů, monitorování jejich chování v reálném čase a aktivním logům, které umožní zpětnou kontrolu jejich rozhodování. Vzhledem k novosti tohoto tématu zatím nejsou tyto metody otestovány, takže teprve čas ukáže, jak co nejlépe zaručit bezpečnost těchto “mechanických pracantů.” Zároveň je ale jen otázka času, než se s nimi každý z nás začne pravidelně potkávat.

⚡Rychlé odkazy a myšlenky

💬 Standa mluvil na Seznam.cz meetupu + Měsíci AI o adversariálních útocích na velké jazykové modely (LLMs).

💡 V rámci Dní AI jsme oba promluvili v pražské Městské knihovně na akci Žárovky. Standa o bezpečnosti AI a Kristina o AI Safety Institutech.

🇪🇺 Evropský parlament používá AI z Anthropicu jménem Claude k rozšíření přístupu ke svým archivům.

📈 Společnost OpenAI nově najala hlavního ekonoma, je jím bývalý Obamův poradce a profesor ekonomie Aaron Chatterji. Měl by se věnovat výzkumu ekonomických dopadů umělé inteligence.

🦾 Pokud vás zaujalo téma agentů, existuje také velmi dlouhý (ale zajímavý) report o etice AI asistentů, který se zabývá například antropomorfizací těchto systémů.

✔️ Švýcarská univerzita ETH Zürich spolu se startupem LatticeFlow AI a bulharským INSAIT představili první nástroj pro vyhodnocování souladu LLMs s evropskou regulací, konkrétně Aktem o AI. Podle prvního testování si modely od společností jako OpenAI, Meta či Mistral AI vedou poměrně dobře, nejhůř dopadaly v oblasti kyberbezpečnosti a diskriminace.

🎉 Kristina publikovala svůj článek o postavení EU ve světě AI: Boosting the EU's Position in AI Through Third Places Diplomacy na platformě Tech Policy Press.

Líbilo se vám dvacáté čtvrté vydání newsletteru Pokrok v AI? Odebírejte ho přímo do vaší emailové schránky a podpořte tím naši práci!

Můžete ho také sdílet s přáteli na sociálních sítích. Jsme vděční za každé sdílení!

Napsali Stanislav a Kristina Fort.

Pár myšlenek k plánování a šachům.

Přijde mi, že opravdu klasické plánovací algoritmy nejsou ideální nástroj pro hraní šachů. To, že když lidi hrají šachy tak se dívají dopředu na pozice, které vzniknou bych popsal jako lidský přístup k prohledávání šachového prostoru. :-)

Já zatím to explicitní "klasické" plánování ve schopnostech LLM moc nevidím. Ale celé plánování je jenom nějaká abstrakce, kterou jsme vymysleli, která nám umožňuje řešit nějaké problémy optimálně.

Přiznám se, že vlastně nevím jestli se jedná o zásadní omezení LLM,.které znamená že něco nezvládnou nebo jenom omezení,.které způsobí že některé druhy problémů se LLM technologii.budou řešit hůř.

Děkuji, vynikající čtení!