👋 Pokrok v AI — newsletter č. 7

Další vydání newsletteru Pokrok v AI je tu a my se ptáme: jak může být AI nebezpečná, když nepozná ani kočku, lol 🤷. Toto a další níže!

Vítejte v sedmém vydání našeho newsletteru Pokrok v AI, ve kterém shrnujeme nejnovější poznatky a vývoj v oblasti používání umělé inteligence (AI), strojového učení (ML) a AI policy a regulace.

🤷 Jak může být AI nebezpečná, když nepozná ani kočku, lol

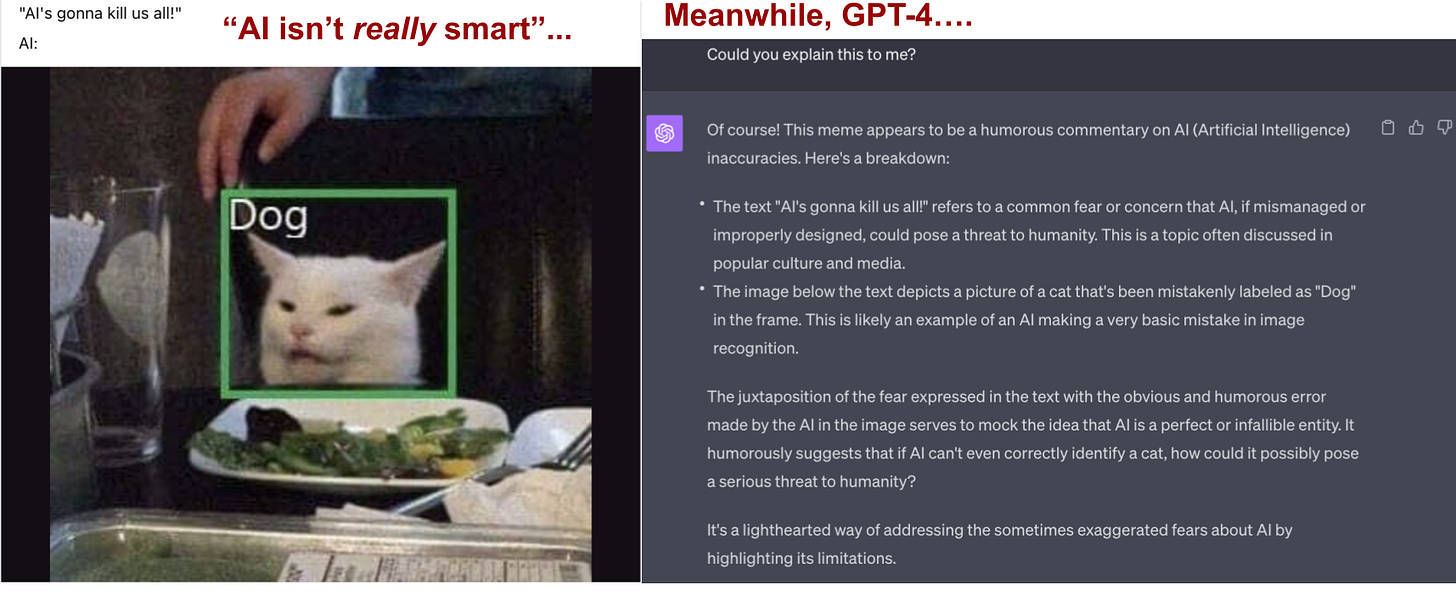

Možná jste na internetu někde zaznamenali meme, ve kterém “AI” na obrázku označí očividnou kočku nálepkou pes, což má ukázat, že AI nemůže být nebezpečná, když ani takhle jednoduchou věc nedokáže udělat správně. Je to očividně takříkajíc blbost, ale podporuje to existující pozici lidí, kteří tvrdí, že vlastně všechno, co se dnes v AI děje, je jen jedna propracovaná miráž. Nedávno jsem na tento obrázek znovu narazil v jedné AI safety memes skupině, jejíž jsem součástí, a rozhodl jsem se otestovat, jak to tedy s tou kočkou doopravdy je, s použitím dnes nejsilnějšího dnes dostupného AI modelu GPT-4. Obrázek společně s textem “AI’s gonna kill as all! AI:” jsem vložil do GPT-4(V), tedy modelu, který umí kromě textu také obrázkovou modalitu a zeptal se:

Could you explain this to me? [Můžeš mi tohle vysvětlit?]

Výstup modelu je vidět v přiloženém obrázku. Můj český překlad:

Samozřejmě! Tento meme se zdá být vtipným komentářem k nepřesnostem umělé inteligence. Zde je detailní popis:

Text "AI nás všechny zabije!" odkazuje na rozšířený strach nebo obavu, že by umělá inteligence mohla v případě špatného řízení nebo nesprávného návrhu představovat hrozbu pro lidstvo. Jedná se o téma často diskutované v populární kultuře a médiích.

Obrázek pod textem zobrazuje kočku, která byla v rámečku omylem označena jako "pes". Jedná se pravděpodobně o příklad, kdy umělá inteligence udělala zcela základní chybu při rozpoznávání obrazu.

Srovnání strachu vyjádřeného v textu se zjevnou a vtipnou chybou, které se umělá inteligence na obrázku dopustila, slouží k zesměšnění představy, že umělá inteligence je dokonalá nebo neomylná entita. Vtipně naznačuje, že pokud AI nedokáže správně identifikovat ani kočku, jak by mohla představovat vážnou hrozbu pro lidstvo?

Je to odlehčený způsob, jak se vypořádat s někdy přehnanými obavami z AI tím, že zdůrazňuje její omezení.

Nejen, že GPT-4 pozná kočku správně (pochybuji, že modely posledních minimálně 5-8 let s něčím takovým měly reálně problém), ale zároveň pochopí správně, o co se v memu jedná, vysvětlí, jakým způsobem kontrastuje obrázek s textem nad ním a vše detailně popíše. Můj post s reakcí GPT-4 se dostal až k “praotci AI safety” Eliezerovi Yudkowskému, který ho tweetoval. Tldr: dnešní AI opravdu nemá problém poznat kočku v obrázku 🤷.

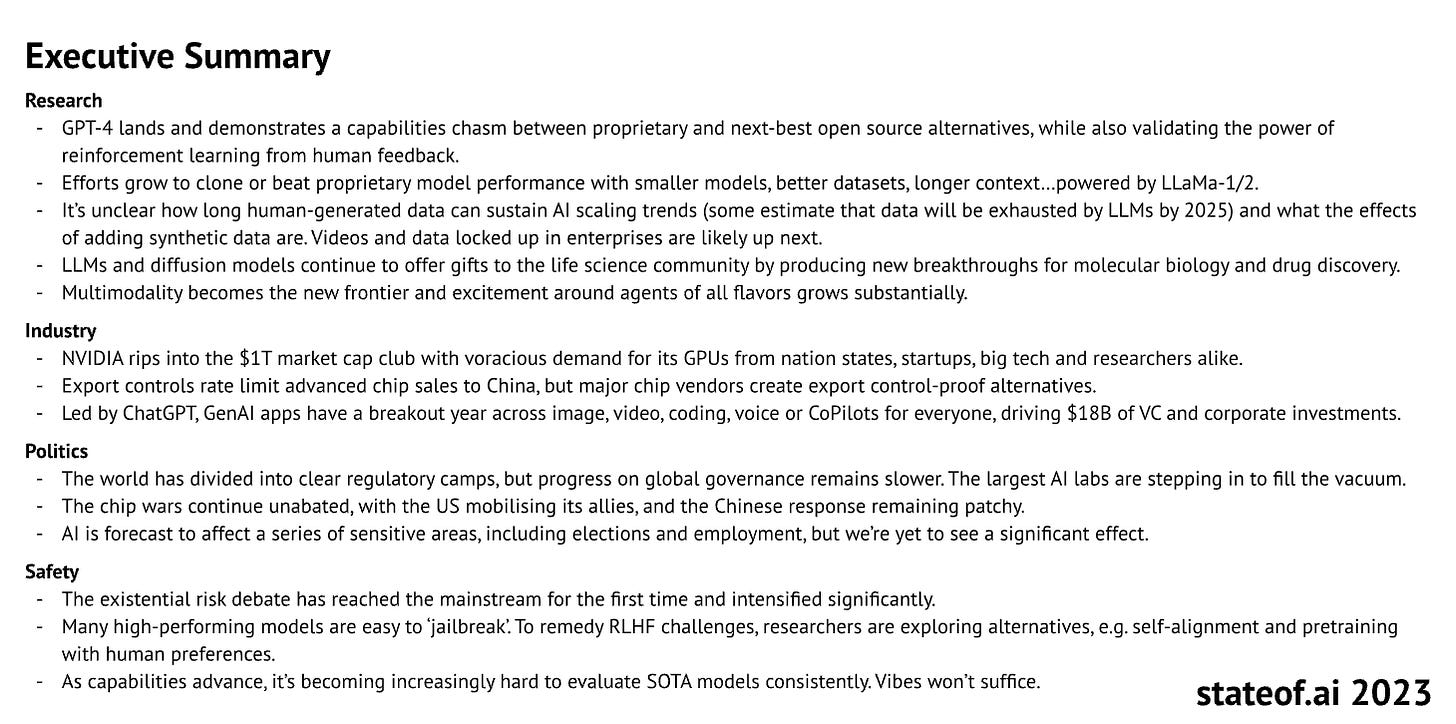

📝 State of AI report pro rok 2023

Minulý týden se objevilo již šesté vydání State of AI reportu, tentokrát pro rok 2023, který analyzuje rozvoj AI ve čtyřech hlavních oblastech: výzkumu, průmyslu, politice a bezpečnosti a zároveň predikuje vývoj v dalším roce. Jeho hlavním autorem je Nathan Benaich z Air Street Capital a se svým týmem ve 163 slidech připravil velice kompaktní a informacemi naplněné shrnutí vývoje AI v posledním roce. Dříve na tomto reportu pracoval Benaich s Ianem Hogarthem, který aktuálně vede britskou pracovní skupinu pro umělou inteligenci (UK’s Frontier AI Taskforce).

Hlavní závěry letošního reportu jsou shrnuty níže. Mezi predikce pro příští rok patří například to, že nějaká mediální společnost používající generativní AI bude vyšetřována pro její zneužití v americké volební kampani příští rok či to, že písnička vygenerovaná AI bude patřit mezi Spotify top hity roku 2024 nebo Billboard Hot 100 top 10.

⚔️ Umělá inteligence v boji

Na konci září se objevila zpráva, že společnost Palantir získala zakázku od amerického ministerstva obrany na výzkum a experimenty s umělou inteligencí a strojovým učením v hodnotě až $250 milionů. Toto oznámení přišlo po tom, co v srpnu americké ministerstvo obrany představilo založení pracovní skupiny pro generativní umělou inteligenci (Taskforce Lima) a v novém roce plánuje další velké investice do výzkumu a vývoje (R&D). Válka na Ukrajině poslední měsíce ukazuje, jak důležitou hrají technologie roli a to přihrává technologickým vojenským společnostem nové zakázky. Ostatně v prosinci 2022 uzavřel Palantir tříletou smlouvu s britským ministerstvem obrany na £75 milionů. Revoluční dopady AI na budoucnost války, která bude nejspíše čím dál více autonomní a ničivá, popsal skvěle Will Knight z Wired. Étos tohoto článku ale vystihl shodou okolností letos v únoru CEO Palantiru Alex Karp, když prohlásil, že ,,Země, která vyhraje AI války budoucnosti, bude nastavovat mezinárodní pořádek.”

➰ Podivné smyčky nejsou potřeba?

Autor a kognitivní vědec Douglas Hofstadter přemýšlel dekády o tom, co dělá člověka a jeho mozek unikátním. Jeho kniha Gödel, Escher, Bach byla formativní pro velké množství lidí, kteří dnes bádají kolem AI a získal za ni i Pulitzerovu cenu. Protože se mu zdálo, že lidé si z GEB, jak se knize důvěrně říká, neodnášejí to klíčové, co se jim snažil sdělit, napsal Hofstadter populárnější a kratší verzi, která se jmenuje I Am a Strange Loop. V ní se autor zabývá myšlenkou, že to, co dělá nás a naši inteligenci speciální, je jistý typ podivných smyček, sebe-referenčních objektů, které nachází mimo inteligenci lidí také v matematice a v Gödelových větách o neúplnosti.

Douglas Hofstadter byl do nedávna velkým veřejným skeptikem kolem AI a naší cesty k obecné inteligenci pomocí hlubokých neuronových sítí, které dnes používáme. (I když existují lidé, kteří říkají, že soukromě, mimo veřejná vystoupení, jeho skepse nebyla tak silná a že měl dlouhodobě obavu z toho, že se k A(G)I rychle přibližujeme). Klíčem k jeho skepsi byly právě ony podivný smyčky, ke kterým odkazuje titul jeho kratší z knih, a o kterém se nám snažil říci už v Gödel, Escher, Bach. Myslel si, že dnešní systémy nemají tento způsob podivné sebe-reference, takže nemohou být inteligentní. Poté, co ale viděl, co umí nejprve ChatGPT a pak GPT-4, silně upravil svou pozici směrem k tomu, že možná tyto smyčky potřeba nejsou. To je podle mého názoru velmi obdivuhodný krok a říká hodně o jeho epistemických standardech — i přes to, že jeho životní dílo stojí na tomto konceptu, síla empirických pozorování ho dovedla k Bayesovskému updatu směrem od něj.

🇪🇺 Kritická umělá inteligence

Zatímco vyjednávání evropského Aktu o AI stále probíhá, oznámila na začátku října Evropská komise, že spolu s členskými státy začne zhodnocovat rizika týkající se čtyř kritických technologických oblastí, konkrétně polovodičů, biotechnologií, kvantových technologií a umělé inteligence. Zhodnocení rizik by mohlo vést k restriktivním opatřením, jako je například omezení vývozu, a mělo by být součástí evropské strategie pro ekonomickou bezpečnost.Tato nová restriktivní opatření týkající se nových technologií by mohla navazovat na již existující politiky některých členských států.

Nizozemský výrobce strojů na výrobu čipů ASML Holding už je například kvůli citlivosti a důležitosti svých výrobků regulován místní vládou a nesmí tak některé výrobky vyvážet bez jejího povolení. Další omezování vývozu transformativních technologií do “rizikových” států na celoevropské úrovni je tak logické. Zmiňované čtyři technologie byly vybrány především proto, že mohou mít negativní dopad na lidská práva či silný zbrojící potenciál. Byť Čína nebyla v oznámení zmíněna, je jasné, že případná restriktivní opatření by byla cílena především na ni. Aby ale mělo ohodnocování rizik na evropské úrovni smysl (a třeba i nějaké výsledky), analytička Agathe Demarais zdůrazňuje, že je potřeba 1. mluvit otevřeněji o Číně, 2. přiznat si, že čistě evropské technologické dodavatelské řetězce jsou zatím spíš sci-fi a 3. zapojit soukromé firmy, neboť většina z nich stejně bude na čínském trhu do větší či menší míry působit.

🇨🇳🀄 Red teaming s čínskými charakteristikami

Čínský úřad standardů vydal návrh doporučení toho, jak by měli výrobci generativních AI modelů dodržovat čínské AI regulace. Návrh doporučuje, jakým způsobem by měli výrobci takzvaně red teamovat svoje modely (red teamingem se v kontextu jazykových a dalších modelů myslí snaha otestovat jejich limity adversariálním útočníkem) a jak zajistit, aby negenerovali ilegální nebo “nezdravý” obsah.

📜 Anthropic demokraticky sesbíral ústavu pro svůj Constitutional AI model

Společnost Anthropic sesbírala názory přibližně 1000 Američanů a Američanek rovnoměrně zastoupených přes kategorie jako jsou věk, gender, příjem a geografie, aby z nich sestavila demokraticky navrženou “ústavu” pro svůj Constitutional AI model (Constitutional AI je alternativní přístup k poslednímu kroku tréninku velkých jazykových modelů, který nahrazuje reinforcement learning on human feedback (RLHF) pomocí explicitně specifikované sady morálních hodnot v přirozeném jazyce, kterým se říká ústava a kterou se model snaží dodržovat pomocí tréninku proti obdobnému kritickému jazykovému modelu; poznámka: Standa je spoluautor článku navrhující tento koncept).

Přes externí firmu podnikající průzkumy veřejného mínění Anthropic získal pohledy veřejnosti na to, jaké normativní hodnoty by AI měla respektovat a podle kterých by se měla chovat. Zajímavostí je, že lidmi takto vytvořená ústava se s tou, kterou již dnes Anthropic ve svém modelu používá, shodovala na 50 %. Hlavní rozdíly byly: veřejnost chtěla, aby AI byla více objektivní a nestranná a dávala větší důraz na co možná nejvíce bezbariérový přístup. Porovnání obou “ústav” je k dispozici zde.

Veřejností navrženou ústavu pak Anthropic použil k tréninku modelu, který se ukázal na standardních testech jako trochu méně biased a zároveň stejně schopný než jejich standardní model. Na druhou stranu, evaluace velkých jazykových modelů začíná být velký problém sám o sobě s tím, jak dnešní nejchytřejší modely velmi úspěšně zvládají i pro lidské experty navržené testy. Toto je pravděpodobně úplně první úspěšný pokus demokratického sbírání morálních hodnot pro AI model a je trochu paradoxní, že ho úspěšně uskutečnil closed-source Anthropic a ne některá z open-source alternativ.

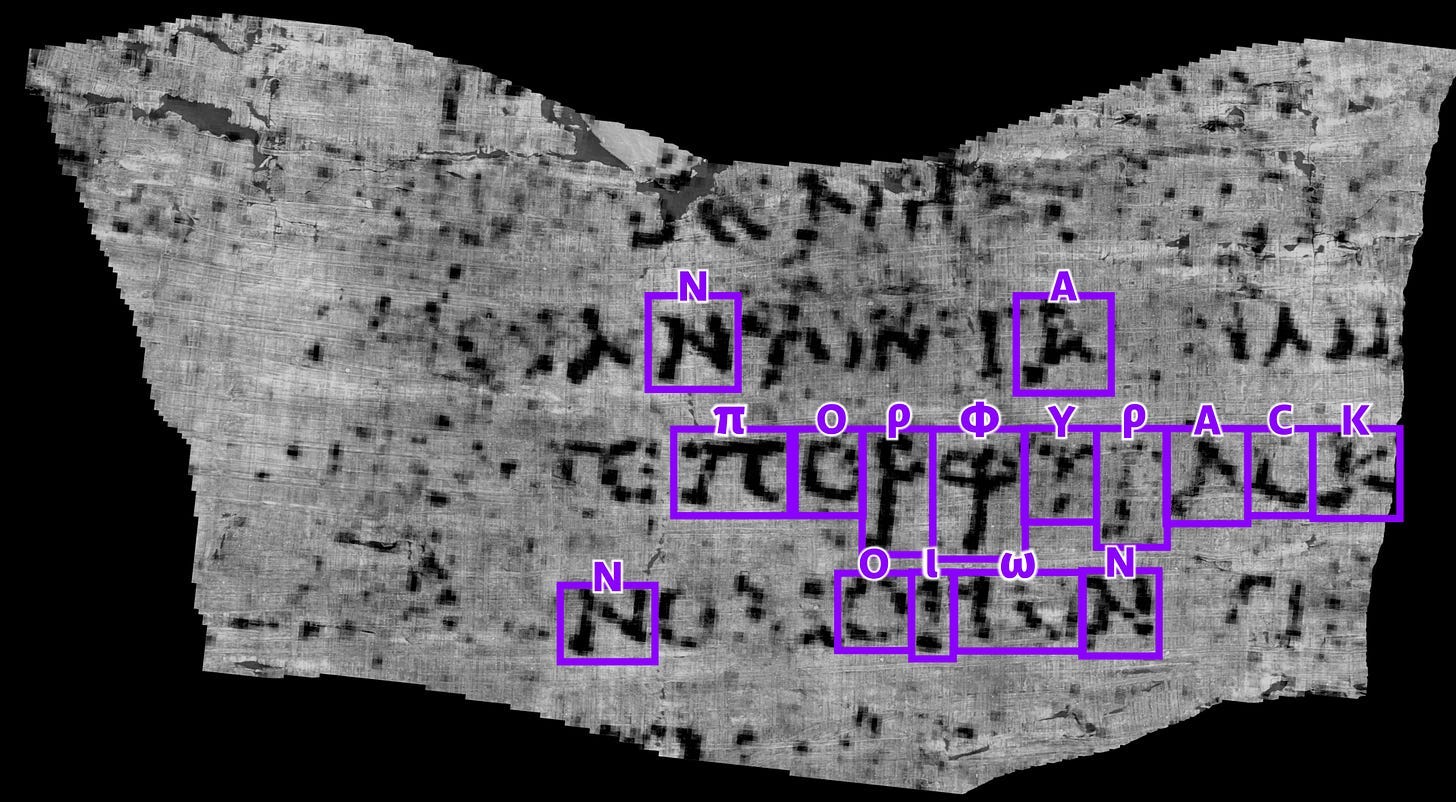

🌋 První slovo ve Vesuvské výzvě

Miliardář, investor a bývalý CEO Githubu Nat Friedman vypsal takzvanou Vesuvskou výzvu, která se pomocí strojového učení a vidění snaží rozluštit obsah svitků papyru, který byl nalezen v Herculaneu. Za rozluštění vypsal ceny v celkové výši $1 milionu. Před pár dny se podařilo přečíst první celé slovo z neotevřeného zuhelnatělého svitku: “fialová barva”. Jednadvacetiletý student počítačové vědy za svůj počin vyhrál $40 000, ale velká cena v hodnotě $700 000 je stále dalších 70 dní otevřena.

Herculaneum je to druhé město, které se, mimo Pompeje, stalo obětí erupce Vesuvu v roce 79 našeho letopočtu. Narozdíl od Pompejí šlo ale o město, ve kterém se nacházely vily římské smetánky a mezi nimi i vila tchána Julia Caesara s obrovskou knihovnou plnou svitků papyru. To vše bylo roku 79 zasypáno 20 metry horkého bahna a popílku.

Vysoká teplota svitky papyru zkarbonizovala – spekla do čených kusů, které vypadají jako uhlí. Zároveň je ale velice dobře uchovala pro budoucí generace. Po staletí, zatímco ostatní antické texty mizely, zůstávaly zuhelnatělé papyry hluboko pod zemí.

V roce 1750 objevil italský farmář při vrtání studny kus mramorového dláždění. Následné vykopávky kromě soch a fresek narazili také na stovky zuhelnatělých papyrů. Kdyby se je podařilo otevřít a přečíst, množství textu z antiky by se zdvojnásobilo. Historické pokusy o jejich rozvinutí a přečtení naráželi ale na jejich velkou křehkost a velkou část jich tak nenávratně zničily. Několik svitků, které jeden italský mnich během dekád rozvíjel, ukázalo filosofické texty psané v řečtině. Více než 600 svitků ale zůstává neotevřených a nepřečtených.

V roce 2015 doktor Brent Seales vytvořil techniku takzvaného virtuálního digitálního rozvinutí, díky které se podařilo “rozvinout” některé svitky bez nutnosti jejich přímého fyzického otevření. Pomocí rentgenové tomografie se tehdy podařilo přečíst takzvaný En-Gedi Scroll, který byl napsán ve staré hebrejštině a který obsahoval text části Tóry. Svitky z Herkulanea jsou ale težší – pigment, kterým byly napsány, je skoro průhledný pro rentgenové paprsky, takže se nedá snadno přečíst i z digitálně rozvinuté verze.

V roce 2019 použil tým doktora Sealese částicový urychlovač, aby naskenoval dva celé svitky z Herkulanea ve vysokém rozlišení 4 až 8 µm s 16 bity hustoty na jeden voxel (voxel je prostorový pixel, tedy pixel ve 3D). I přes to, že text nebylo možné přímo přečíst, tým veřil, že rapidní pokrok ve strojovém učení a vidění by jim mohl pomoci. To se podařilo v roce 2023, kdy se strojově učícímu modelu z jejich laboratoře podařilo přečíst některé znaky. Tím tým efektivně demonstroval, že je jejich cíl možný.

Nat Friedman se o tomto projektu hodně rozpovídal v podcastu od Dwarkeshe Patela. Věří, že síla finančních incentiv společně s kreativní a intelektuální silou open source komunity v umělé inteligence může udělat ten poslední krok a pomocí strojového učení potenciálně zdvojnásobit množství textu, které máme z antiky. Zdá se, že měl asi pravdu! Uvidíme, kdo si nakonec odnese hlavní cenu $700 000 a nemůžu se dočkat, co v knihovně tchána Julia Caesara nakonec najdeme!

⚡Rychlé odkazy a doporučení

🚗 Americký magazín Wired píše o tom, jak legacy výrobci aut, jako jsou Volkswagen nebo General Motors, nečekali a zaspali růst Tesly a teď úplně stejně zaspávají čínské výrobce elektromobilů. Standova predikce: bude to hodně špatné pro ČR a státy propojené s německou ekonomikou obecně.

💬 Standa dal rozhovor pro týdeník E15 o AI a technologické budoucnosti Evropy a další rozhovor pro univerzitní časopis Universitas.

🌎 Nová analýza Rest of the World porovnala 3000 obrázků generovaných AI a ukazuje, jak AI často redukuje svět do stereotypů.

🔢 Skvělé interview v podcastu s Dwarkeshem Patelem s autorem matematických videí 3Blue1Brown (jestli je neznáte, tak o hodně přicházíte — jsou to jedny z nejlepších vysvětlení matematiky vůbec a typická videa mají nad milion a často i deset milionů shlédnutí) Grantem Sandersonem, který začal youtubová videa natáček na konci svého bakaláře na Stanfordu.

💥 Marc Andreessen — autor prvního internetového prohlížeče, miliardář a general partner ve venture capital (VC) firmě a16z — publikoval svoje techno-optimistické manifesto a mluvil o něm ve svém Twitter/X vlákně.

💵 Děkujeme naše prvnímu, druhému i třetímu platícímu předplatiteli. Pokud chcete finančně podpořit naší práci, můžete přejít z Free na Paid subscription.

Líbilo se vám sedmé vydání newsletteru Pokrok v AI? Odebírejte ho přímo do vaší emailové schránky a podpořte tím naši práci!

Můžete ho také sdílet s přáteli na sociálních sítích.

Napsali Stanislav a Kristina Fort.