👋 Pokrok v AI — newsletter č. 14

Přinášíme další zprávy ze světa AI, tentokrát o tom, co může zpomalit pokrok v AI, jak dopadla Vesuvská výzva, proč nemá EU OpenAI a jak se vyvíjely obavy z A(G)I.

Vítejte ve čtrnáctém vydání našeho newsletteru Pokrok v AI, ve kterém shrnujeme nejnovější poznatky a vývoj v oblasti používání umělé inteligence (AI), strojového učení (ML) a AI policy a regulace.

✋ Pokrok AI a co ho může zpomalit

,,Pokrok v AI závisí na talentovaných výzkumnících a výzkumnicích, dobře navržených algoritmech, kvalitních data setech a mocném hardwaru,” tak začíná publikace z loňského roku od Center for Security and Emerging Technology při americké Georgetown University. Toto tvrzení je založené na průzkumu mezi 400 AI odborníky a odbornicemi, z něhož vychází, že podpora talentovaných jedinců v této oblasti je klíčová pro její další rozvoj.

Byť z výše zmiňovaného průzkumu vyplývá, že k potřebnému výpočetnímu výkonu má většina výzkumníků přístup a není tedy tak zásadní, AI společnosti přesto mají problém svůj hlad po čipech plně uspokojit. V září 2023 předseda největší společnosti vyrábějící polovodiče (také známé jako čipy) – tchajwanské TSMC – prohlásil, že aktuálně mohou naplnit jen 80 % potřeb svých zákazníků. Výroba čipů je extrémně specializovaná a komplikovaná, a proto je nedostatek společností, které by mohly rostoucí poptávku ukojit.

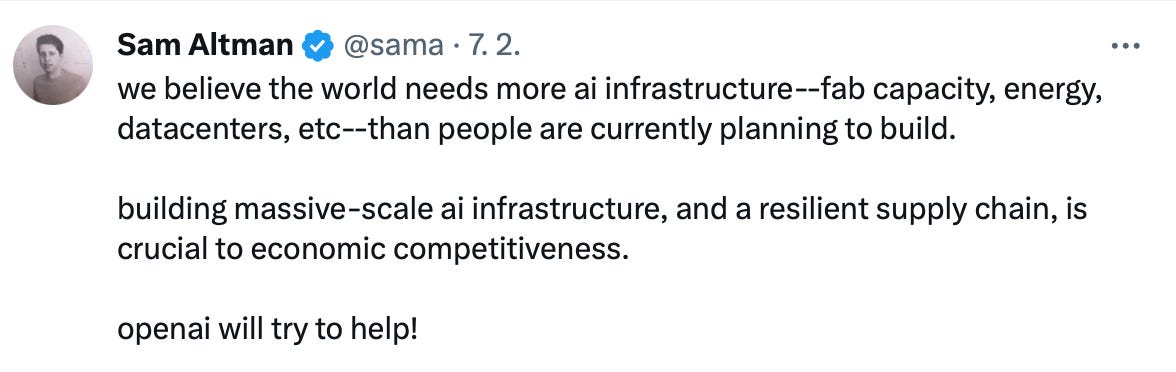

Podle Bloomberg se proto Sam Altman, proslulý CEO AI laboratoře OpenAI, snaží sehnat zdroje na vytvoření sítě továren na výrobu polovodičů, která by umožnila naplnit stále se zvedající poptávku, která bude pravděpodobně dál růst i v následujících dekádách s rozvojem AI. Tyto spekulace pak potvrzuje i tweet Sama Altmana z minulého týdne. Pokud tento plán vyjde, vytvoření takových továren a získání kvalifikované pracovní síly bude pravděpodobně stejně trvat několik (desítek) let. Výroba čipů je totiž aktuálně vysoce specializovaná a koncentrovaná do rukou několika mála aktérů, kteří vlastní know-how, jak čipy co nejefektivněji produkovat. Každopádně ale budeme vývoj v této oblasti bedlivě sledovat.

🌋 Vesuvská výzva úspěšně vyřešena

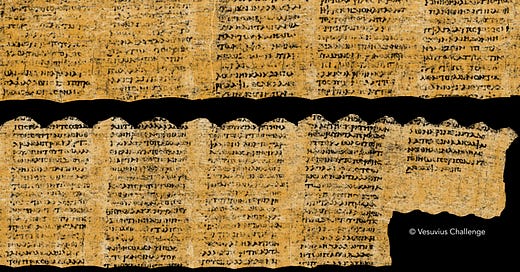

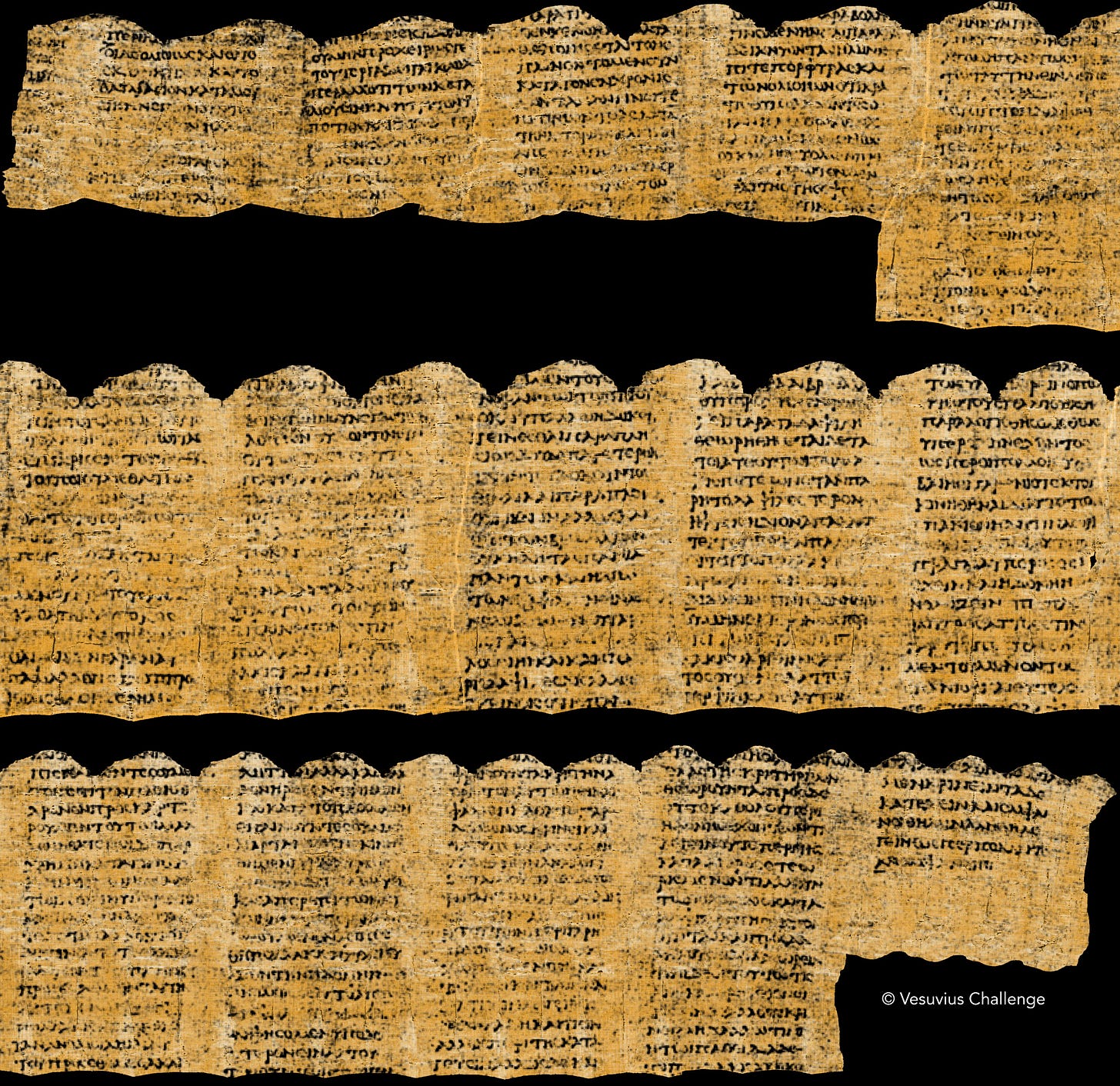

Vesuvská výzva (Vesuvius Challenge) miliardáře, investora a bývalého CEO Githubu Nata Friedmana, o rozluštění jejíhož prvního slova jsme psali v předchozím vydání, byla po 10 měsících úspěšně vyřešena! Poprvé po dvou tisících letech můžeme tedy číst antické texty, které se v jiné formě nezachovaly:

Cílem Vesuvské výzvy bylo pomocí strojového učení a počítačového vidění odkrýt text ze svitků papyru, které byly bleskově zuhelnatělé při erupci sopky Vesuv v roce 79 našeho letopočtu. Svitky byly nalezeny ve vile bohatého tchána Julia Caesara ve městě Herkulaneum (to druhé velké římské město, které se stalo obětí exploze sopky Vesuv společně se známějšími Pompejemi).

Vítězi soutěže se nakonec stávají mladí vědci-inženýři (Youssef Nader z Německa, Luke Farritor z USA a Julian Schilliger ze Švýcarska), kteří si mezi sebe rozdělí velkou cenu v celkové hodnotě $700 000, tedy něco přes 16 milonů korun. Patnáct sloupců textu na obrázku nahoře pochází z konce prvního svitku a obsahují nový, dříve neznámý text ze starověku (ze kterého je obecně dochováno jen malé množství textu). Autorem je pravděpodobně epikurejský filosof Philodemus a v pasáži mluví o hudbě, jídle a užívání si života.

Vesuvská výzva pokračuje dál i v roce 2024. Text v obrázku totiž představuje pouhých 5 % jediného svitku — 4 další už jsou nyní naskenované a čekají na přečtení. V Neapoli jsou také připraveny další svitky, ve kterých by se mělo nacházet asi 16 megabytů (!) potenciálně nového, neznámého textu z antiky. Ve vile tchána Julia Caesara, ve které se papyry našly, podle některých expertů mohou být další tisíce (a možná i desetitisíce) prozatím skrytých a nevykopaných svitků. Nat Friedman doufá, že úspěšné rozklíčování textu v rámci Vesuvské výzvy bude motivovat jak státní instituce, tak i soukromé dárce, aby provedli detailní a hloubkový archeologický výzkum této vily — je možné, že díky této iniciativě by se mohlo celkové množství textu dochované z antiky zněkolikanásobit.

🇪🇺 Nemá Evropa OpenAI kvůli regulaci?

Jeden z narativů plujících v českém mediálním prostoru, které (minimálně polovinu z nás) dokáže zvednout ze židle, je tvrzení, že v Evropě se nejlepší AI nerozvíjí jen kvůli regulaci. Je zvláštní, že tento narativ převládá přesto, že čistě na AI zaměřené regulace v Evropě zatím ani neplatí, Akt o AI byl dojednán teprve v prosinci loňského roku a k jeho odsouhlasení dojde pravděpodobně letos na jaře. Prokazují tak potenciální nevědomost a neznalost základních faktů i výzkumu na téma toho, na čem rozvoj AI opravdu záleží (viz příspěvek Rozvoj AI a co ho může zpomalit, který jste pravděpodobně před minutou dočetli).

Příčinou nedostatku úspěšných AI firem na evropském kontinentu tak velmi pravděpodobně není jen regulace (i když například uzákonění zaměstnaneckých akcií by určitě Česku pomohlo), ale spíš nedostatek talentu a financování, které by rozvoj takových firem umožnilo. Paprskem naděje pro evropskou AI může být francouzský start-up Mistral AI, o kterém jsme už v minulosti několikrát psali a který založili francouzští výzkumníci Arthur Mensch, Guillaume Lample a Timothée Lacroix, kteří přinesli zkušenosti ze společností Google DeepMind a Meta. Mistral AI byl v prosinci 2023 valuován na hodnotu 2 miliard dolarů. Dokazuje tak, že i evropské firmy mají stále šanci.

AI regulace každopádně potřeba je. Skvělým příkladem může být fakt, že velká část AI-generovaného obsahu je deepfake porno (podle studie z roku 2019 až 96 %). Ať už se šíří deepfake sexuálně explicitní materiály s obličejem známé popstar nebo nezletilých spolužaček, proti této formě zastrašování a ponižování (především) žen je potřeba bojovat efektivní regulací. Nastavení legislativy tak, aby firmy musely řešit problémy, které z používání jejich nástrojů vznikají, je tak naprosto klíčové. Zároveň bývá jasný právní rámec pro soukromý sektor dost důležitý, protože usnadňuje fungování na daném trhu a pomáhá předcházet případným problémům s úřady (např. krypto sektor po legislativní jasnosti v USA dlouhodobě volá).

🏜️ Butlerovský jihad a zrod obav z A(G)I

Série sci-fi knih od Franka Herberta, Duna, se teď dočkala nové filmové adaptace, jejíž druhý díl bude vycházet v kinech v březnu. Svět Duny je pro moderní čtenářstvo podivný v mnoha ohledech, ale jeden z nejrozdílnějších aspektů (kromě obřích červů, kteří vylučují halucinogenní látku, pomocí které navigují tou samou látkou zmutovaní lidé mezihvězdný prostor…) je neexistence počítačů a natož umělé inteligence. Ve vesmíru Duny vše dělají různě geneticky modifikovaní a speciálně trénovaní lidé. Roli “počítačů” hraji v tomto světě třída lidí zvaní mentats, kteří provádějí komplikované výpočty z hlavy.

Nabízí se tedy otázka — jak to, že v Duně neexistují počítače ani umělá inteligence. Kanonická odpověď je podle příběhu takzvaný Butlerovský jihad (Butlerian jihad, jihad ve smyslu svaté války), což byl podle příběhu historický konflikt mezi lidmi a “myslícími” stroji (thinking machines), jehož důsledkem byla totální destrukce v podstatě všech forem počítačů, “myslících” strojů a vědomých robotů. Výsledkem bylo až náboženská tabu proti tvorbě AI vyjádřené přikázáním:

Thou shalt not make a machine in the likeness of a human mind.

[Ve volném překladu: Nestvoříš stroj k obrazu lidské mysli.]

Butler, ke kterému odkazuje dílo Franka Herberta, se k mému překvapení ukázal jako reálná historická postava. Už v roce 1872 napsal anglický novelista a kritik (= takže wordcel a ne shape rotator) Samuel Butler satiricko-utopický román Erewhon, ve kterém mluví o nebezpečí, které pro lidstvo “přemýšlející” stroje představují. Jeho ještě dřívější esej, Darwin among the Machines (1863), dokonce navrhuje, abychom všechny pokročilé stroje rovnou zničili.

I přes dnešní obskurnost tohoto propojení se zdá, že tento historický fakt byl znám mnoha lidem, jako jsou například autoři George Orwell a CS Lewis, a nebo jeden z velikánů matematiky, informatiky a umělé inteligence Alan Turing. Turing sám o nebezpečích pokročilé umělé inteligence a něčeho, co se nápadně podobá inteligenční explozi, sám psal (ponecháno v původním znění, zvýraznění je naše):

Let us now assume, for the sake of argument, that these machines are a genuine possibility, and look at the consequences of constructing them. To do so would of course meet with great opposition, unless we have advanced greatly in religious toleration from the days of Galileo. There would be great opposition from the intellectuals who were afraid of being put out of a job. It is probable though that the intellectuals would be mistaken about this. There would be plenty to do, [trying to understand what the machines were trying to say,]² i.e. in trying to keep one's intelligence up to the standard set by the machines, for it seems probable that once the machine thinking method had started, it would not take long to outstrip our feeble powers. There would be no question of the machines dying, and they would be able to converse with each other to sharpen their wits. At some stage therefore we should have to expect the machines to take control, in the way that is mentioned in Samuel Butler's 'Erewhon'.

[2]: Editor's note. The words 'trying to understand what the machines were trying to say,' are handwritten and are marked in the margin 'Inserted from Turing's Typescript'

Část, ve které Alan Turning píše “it seems probable that once the machine thinking method had started, it would not take long to outstrip our feeble powers” je na svou dobu velice lucidním vhledem do toho, že úroveň lidské inteligence není přirozeným stropem pro to, jak inteligentní mohou jiná stvoření nebo stroje být.

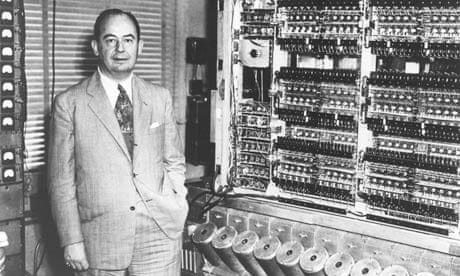

John von Neumann, absolutní génius, podle mnohých nejchytřejší člověk, který kdy žil, a vědec, který stál u zrodu více oborů než kdokoli před ním a nejspíše i po něm, stál také, kromě své práce na atomové a vodíkové bombě, u zrodu počítačů. Během roku 1945 se podle jeho biografie jednou probudil z noční můry a řekl své ženě Klari:

What we are creating now is a monster whose influence is going to change history, provided there is any history left. Yet it would be impossible not to see it through.

[Volný překlad: Co tady teď tvoříme je monstrum, jehož dopad změní budoucnost, pokud tedy vůbec nějaká budoucnost zůstane. Přesto je nemožné, abychom jeho tvorbu nedokončili.]

Von Neumann stavěl první počítače, aby pomohli s vývojem atomové bomby. Byly to ale právě počítače a jejich budoucí vývoj a ne jaderné zbraně, ze kterých měl větší strach.

Je zajímavé, jak dlouho historii přemýšlení o nebezpečích A(G)I má a jak daleko do budoucnosti dohlédli lidé, jejichž jediný “počítač”, se kterým mohli pracovat, byl glorifikovanou mechanickou kalkulačkou. Může se nám to sice nelíbit, ale je historickým faktem, že nad podobnými otázkami a s podobnými závěry přemýšleli lidé různých intelektuální zaměření a vysokého kalibru od začátku počítačové revoluce a někdy i dříve.

🔀 Korekce

V minulém vydání newsletteru jsme psali o systémů AlphaGeometry a říkali jsme o něm například: “AlphaGeometry “získává” zlatou medaili na Matematické olympiádě”. Několik čtenářů-matematiků zmínilo, že to není úplně přesné tvrzení a proto jsme se rozhodli udělat korekci. Fakticky přesnější by bylo říci, že na geometrických problémech z Mezinárodní matematické olympiády dosahuje systém AlphaGeometry úspěšnosti, která je porovnatelná se zlatými medailisty z této soutěže.

⚡Rychlé odkazy a myšlenky

🇪🇺 Velvyslanci členských států schválili finální verzi Aktu o AI. Teď už chybí jen souhlasy výboru pro vnitřní trh a ochranu spotřebitelů Evropského parlamentu, plenárního shromáždění Evropského parlamentu a ministrů členských států.

🛂 Kristi vyšel na blogu LSE článek vycházející z její dizertace. Věnuje se používání algoritmických a na AI založených nástrojů na hranicích Evropské unie. I tuto oblast by měl Akt o AI částečně regulovat.

🇨🇳 Tento článek stručně shrnuje čtyři věci, které byste měli vědět o čínské AI regulaci v roce 2024.

🇸🇬 Singapore představil svůj rámec pro důvěryhodný vývoj generativní AI, který rozvíjí původní rámec zaměřený na “tradiční AI” z roku 2020.

Líbilo se vám čtrnácté vydání newsletteru Pokrok v AI? Odebírejte ho přímo do vaší emailové schránky a podpořte tím naši práci!

Můžete ho také sdílet s přáteli na sociálních sítích.

Napsali Stanislav a Kristina Fort.